Кража личных данных является одним из наиболее быстро растущих преступлений в США, в последние годы личность миллионов людей была скомпрометирована. В 2019 году Федеральная торговая комиссия получила 3,2 миллиона сообщений о проблемах защиты прав потребителей. Из них наиболее распространенным мошенничеством, о котором сообщалось, были мошенничества и кража личных данных, особенно в государственных службах, онлайн-магазинах и кредитных бюро.

Увеличение числа случаев утечки данных способствовало увеличению случаев хищения личных данных на 120% и мошенничества с учетными записями. Это делает цифровую регистрацию клиентов рискованным делом для бизнеса, и из-за этих угроз предприятия внедряют более совершенные продукты для решения этих проблем. Многие интернет-компании все чаще внедряют решения на базе AI, которые требуют от пользователей проверки их личности.

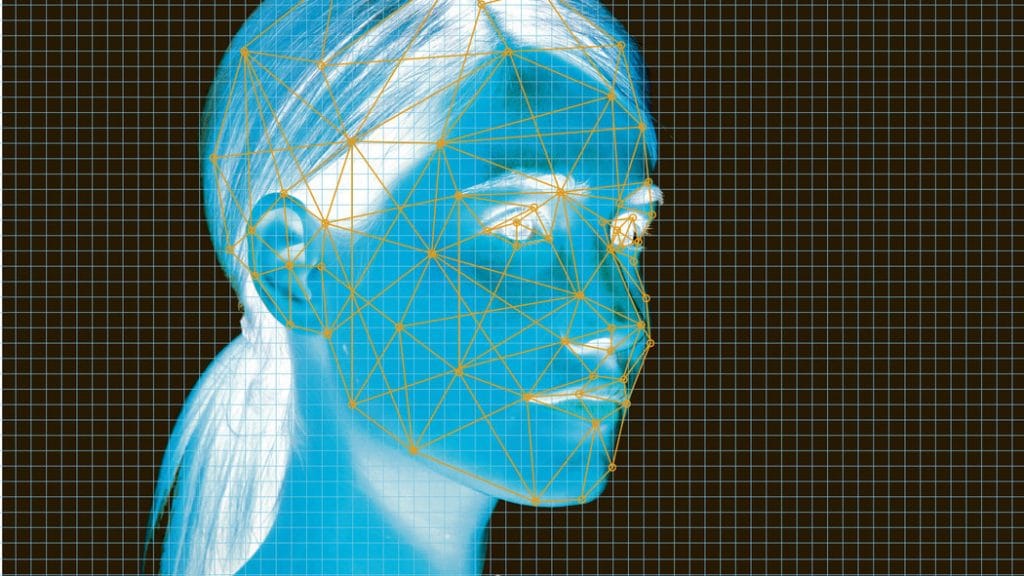

Старые и традиционные методы аутентификации заменяются биометрической верификацией. Биометрия использует уникальные биологические черты человека для проверки его личности. Эта идентификация имеет больший потенциал, чем методы аутентификации, основанные на владении и знаниях. Тем не менее, биометрическая аутентификация также подвержена атакам. Большинство наблюдаемых атак включают атаки на презентацию, такие как подделка, печатная атака, глубокая подделка, 3D-Маска и макияж.

Deepfakes и spoof атаки с обнаружением живости

Deepfakes распространяют дезинформацию, это еще одна серьезная проблема, связанная с манипулированием персональными аудио-, видео- и другими цифровыми следами, может оказать огромное влияние. По мере того, как все больше и больше данных передается в режиме онлайн, глубокие подделки станут более проблематичными для тех, кто подвержен краже личных данных.

По словам Роберта Кэппса (Robert Capps), вице-президента по маркетинговым инновациям в NuData Security, компании Mastercard, злоумышленники могут использовать deepfake, чтобы убедительно имитировать подобие человека, по-прежнему трудно имитировать чей-то голос без каких-либо явных недостатков. Он также добавил, что в настоящее время не может быть воспроизведено глубокое аудио или видео в реальном времени без злоумышленника, имеющего большой объем вычислительных ресурсов и большое количество высококачественных аудио / видео исходных материалов для обучения компьютерным алгоритмам машинного обучения.

В то время как deepfakes может быть убедительным для других людей, они не могут пройти физическую или пассивную биометрическую проверку, поэтому соединение сильного обнаружения живости, наряду со сбором пассивных и физических биометрических сигналов для проверки личности пользователя, в значительной степени смягчает текущие риски, связанные с банковскими операциями.

По материалам Biometrics Research Group. Автор Sarah Amundsson