Программисты из Калифорнийского университета в Риверсайде разработали новый метод поиска поддельных видео. Предложенный подход оказался эффективнее всех существующих методов при обнаружении изменений эмоций.

Исследователи из Калифорнийского университета в Риверсайде представили новую технологию поиска изменений выражения лица на видеозаписях. Разработанный метод делит задачу на два компонента, которые решаются при помощи обученной нейронной сети.

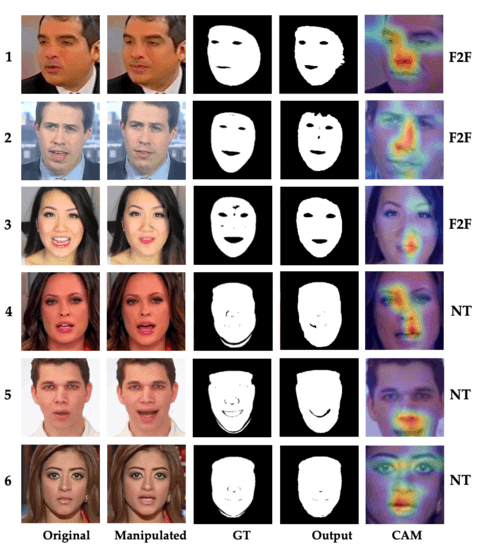

Первая ветвь различает выражения лица (эмоцию) и передает информацию об областях, формирующих это выражение, во вторую ветвь — кодер-декодер. Архитектура кодер-декодер отвечает за обнаружение и локализацию манипуляций. Как отмечают авторы работы, созданное ими решение не только обнаруживает вмешательства, но и определяет области изображения, которые были исправлены.

«Глубокое обучение использует характерные черты, выявленные системами распознавания выражений лица, для улучшения работы обычных систем поиска изменений. Такой подход обеспечивает впечатляющие результаты при обнаружении манипуляций с выражением лица», — говорит Газал Мазахери, руководитель исследования.

Исследователи использовали для оценки эффективности своей модели два набора видео, в одном из которых изменениям подверглись только эмоции, в другом поменялся действующий персонаж. Эксперименты показали, что разработанная система гораздо эффективнее существующих аналогов в части поиска изменений эмоций и при этом не уступает наиболее эффективным системам обнаружения подмены личности действующего лица. В процессе тестирования система обнаружила 99% поддельных видео.

Ученые считают, что их разработка поможет в разработке автоматизированных инструментов для обнаружения фальшивых видео, содержащих пропаганду или дезинформацию.

По материалам Хайтек