Возможно, вам пишут мошенники. Если вы уверены, что они не могли получить никаких ваших интимных фото или видео, значит, максимум, что им доступно, — использовать дипфейк, технологию, которая накладывает фото вашего лица на видео или другое изображение

Автор: DFC

UneeQ Creator – это платформа, которая позволяет создавать цифровых сотрудников, способных взаимодействовать с клиентами, как это сделал бы человек

Практика показывает, что жертвой дипфейка может стать не только звезда экрана или известный политик, но и обычный человек. Раскрываем алгоритм законных действий против технологии преступного обмана

Увлечение простыми подростками порно с обменом лицами превращается в мошеннические видео- и аудио-атаки, направленные на стратегии безопасности

Теперь при отправке ссылки на регистрацию можно создать короткое видеоприглашение. Пользователи могут выбрать пол, язык и даже вставить в ролик своё лицо

Да, у них ещё скованные и угловатые движения. Но с ними уже работают лучшие хореографы. Посмотрим, что нас ожидает через 5 лет

Виртуальные ведущие и кибер-звезды могут взять на себя рутинные задачи, удешевить и ускорить производство контента и снизить репутационные риски

Вирусолог лаборатории Аманда Фелпс сообщила, что протез схож с настоящим человеческим пальцем, имеет такие же изгибы и имитирует кожный жир

Британская компания Flawless создала решение на базе искусственного интеллекта, которое изменит лицо актера, чтобы оно соответствовало словам в фильме

Эксперты считают, что в России возможности использования синтетических лиц недооценены, при том, что это направление обладает большим потенциалом

Выступление IT директор ООО «АБК» Сергея Макарова с презентацией о будущем подобных технологий и о текущих разработках по генерации изображения и синтезу речи

В то время как цифровая идентификация глубже проникает в нашу жизнь, она также привлекает новые угрозы в виде продвинутого программного обеспечения deepfake

Нередко мошенники могут представляться организациями, занимающимися благотворительностью или проводящими социальные опросы. Таким образом они могут получить у вас все необходимые данные под видом невинных вопросов

Чтобы создать эти уроки, вам необходимо пройти через написание сценариев, создание визуального контента, аудиозапись и общее редактирование и распространение

Для Facebook дипфейки пока ещё не являются большой проблемой, но компания продолжает финансировать исследования, связанные с этой технологией

Перед выборами президента США в 2020 году интернет-платформы обновили правила. Многие из них запретили публикацию deepfake-фото и видео

Палата представителей конгресса США признала дипфейки опасным изобретением, ведь таким образом можно подделывать уголовные материалы

И нередко случается, когда люди действительно оплачивают лжеуслуги. На конференции также обсудили Deepfake – новый вызов для киберполицейского

Если зритель попытается поделиться таким роликом, он увидит подсказку, напоминающую ему, что это видео было помечено как непроверенный контент

Использование поддельных видео- и аудиотехнологий может стать серьезной киберугрозой для бизнеса, прогнозирует специалист по кибер-аналитике CyberCube

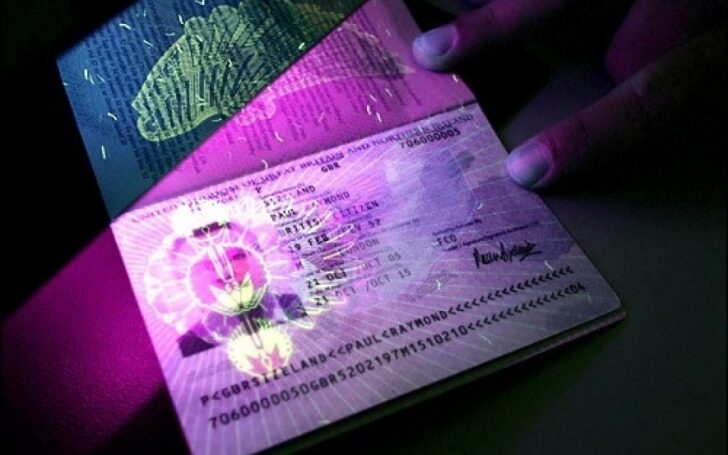

В новом отчете Secure Identity Alliance о мошенничестве с паспортами говорится о уязвимости проездных документов, даже биометрических паспортов

Генеративные технологии устроены так, что каждая следующая «подделка» лучше предыдущей. Технологии детекции всегда будут отставать на полшага

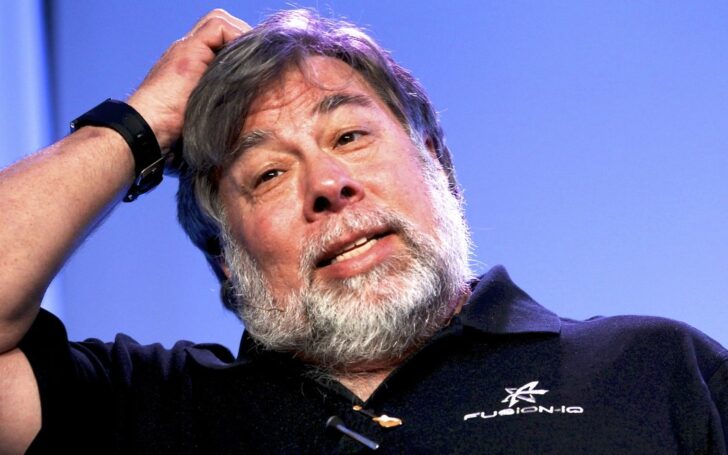

На видео мошенники от лица Стива Возняка, Билла Гейтса и Илона Маска обещали, что любой, кто переведёт биткоины на кошелёк, сможет забрать в два раза больше

Mitek приобрела компанию ID R&D за 49 миллионов долларов, чтобы интегрировать ее биометрические данные по лицу и голосу, а также возможности обнаружения живости

Инновационные технологии в кино стали одной из ключевых тем первого дня международного форума креативных лидеров и мира интеллектуальной собственности