Мошенничество с использованием синтетических идентификационных данных является одним из самых быстрорастущих финансовых преступлений в мире

Рубрика: Обман

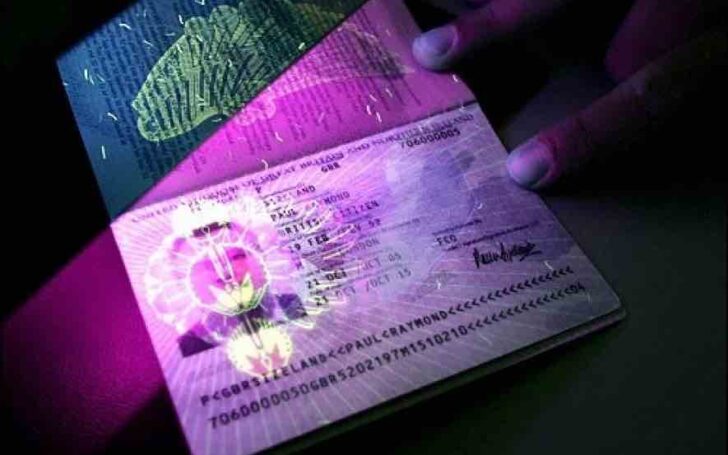

Индийцы вскоре смогут получить свои долгожданные электронные паспорта, оснащенные биометрическими чипами, соответствующими по последним стандартам ИКАО

За этот год искусственный интеллект (ИИ), особенно ChatGPT и Bard, получил широкое освещение благодаря их способности генерировать широкий спектр результатов

В Индии стремительно растёт число случаев финансового мошенничества, связанного с уникальным биометрическим идентификатором страны Aadhaar

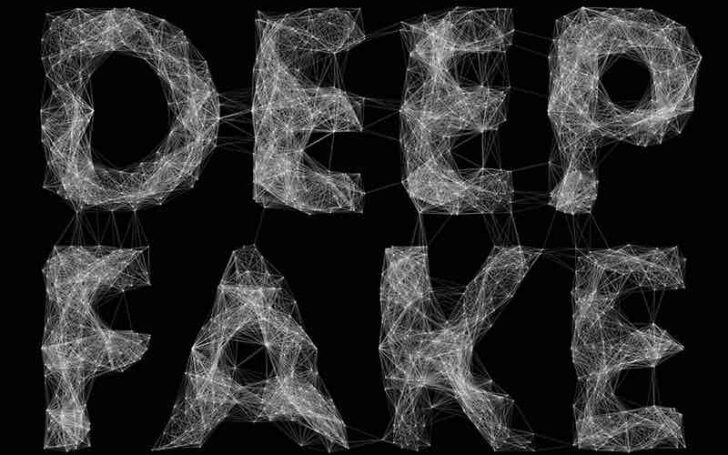

Эксперты и прочие люди, тесно знакомые с Deepfake, уже активно выступают против планов правительства США использовать эту технологию в своих кампаниях

Фотограф из Берлина Борис Эльдагсен не стал присваивать себе лавры победы в конкурсе Sony World Photography Award и отказался от престижной награды

Главный редактор Die Aktuelle Анне Хоффманн, отвечавшая за работу издания с 2009 года, освобождена от своих обязанностей

В 2022 году мобильные абоненты в глобальном масштабе потеряли приблизительно $53 млрд из-за телефонного мошенничества и нежелательных звонков

В компании утверждают, что это правило действует уже десяток лет, и что речь не идёт о будущем генеративном ИИ, который разрабатывает компания

Генеральный директор Tesla Илон Маск по-прежнему является мишенью для онлайн-мошенников, которые используют его образ, чтобы похищать у трейдеров деньги

Языковые модели можно настроить так, чтобы они выдавали варьирующиеся тексты на заданную потенциальными злоумышленниками тему

Фальшивая личность и украденное портфолио: создатель агентства дизайна в Лондоне убедил десятки людей работать бесплатно

Преимущество эпохи развития интернета и технологий в том, что почти все её новые возможности легкодоступны. Но в этом и её большая опасность

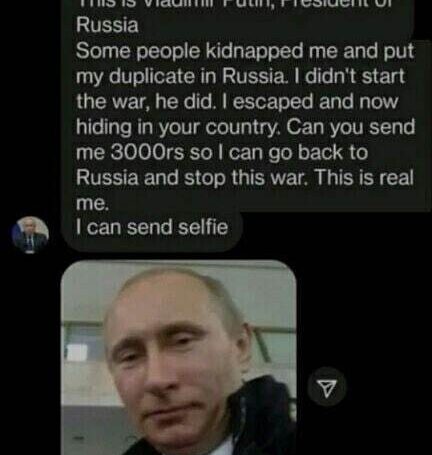

Индийские мошенники представляются Путиным и за $40 (3 тысячи рублей) предлагают сделать селфи, чтобы подтвердить свою личность

Сергей Судариков обратился с заявлением, что ему поступил звонок от мужчины, который представился знакомым и попросил перевести средства на лечение ребенка

В последнее время злоумышленники научились использовать нейросети — с их помощью на основе реальных записей человека они создают поддельное видео для шантажа

Общее количество попыток мошенничества с идентификационными данными увеличилось на 3,36% в 2020 году, в то время как 22,44% всех попыток проверки лица

Заявление официального представителя FIA, переданное Dawn, и достоверность всей статьи были опровергнуты как NADRA, так и FIA

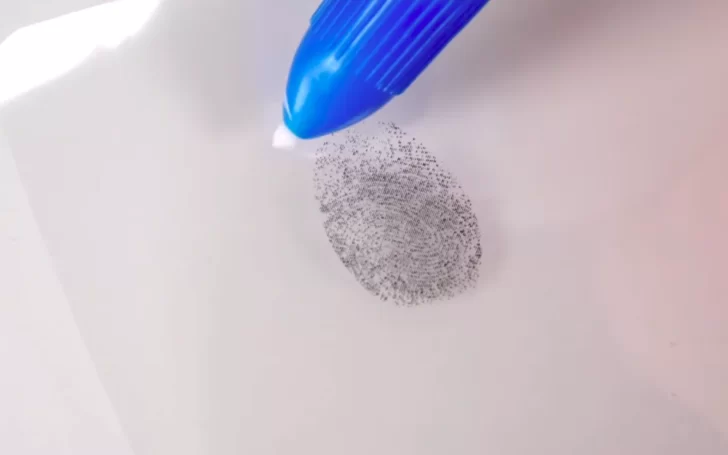

Если вам есть что терять и вы можете стать целью мотивированного преступника, не следует использовать аутентификацию по отпечатку пальца

Когда 46-летняя Теэле из эстонского городка Тори перевела Локи из фильма «Тор» все свои деньги, то поняла, что стала жертвой мошенничества по технологии дипфейк

Ютьюбер и футболист Крис Диксон снял ролик о своем коте, в котором тот мастерски отбивает все удары по воротам. Умения кота похвалили даже в мюнхенской Баварии

Облачные ресурсы, способны «проверить» залитое в них видео на наличие различных «примесей» и установить: оригинальный ли это файл или нет

С развитием информационных технологий в области искусственного интеллекта стало возможно подделывать видео и голос для выманивания денег

Существует два типа «лжецов»: те, кто активирует определенные мышцы щеки, когда они лгут, и те, кто активирует свои брови

Мошенники стали шантажировать россиян, которые пытаются их троллить. Злоумышленникам нужен насыщенный звонок, чтобы потом смонтировать его и потребовать деньги