Современные технологии уже сегодня позволяют буквально за пару кликов с помощью нейросетей поменять лицо персонажа из фильма

Рубрика: Обман

Эксперты США заявляют о том, что в ближайшее время технология глубинных подделок может представлять серьёзную опасность для национальной безопасности

Одним из победителей форума «ВУЗПРОМЭКСПО» названа система искусственного интеллекта по отлову фейков. Эту разработку отметило жюри конкурса

С мужчинами в соцсетях связываются женщины с фейковых аккаунтов, а затем звонят по видео, общаются с пользователем и производят действия сексуального характера

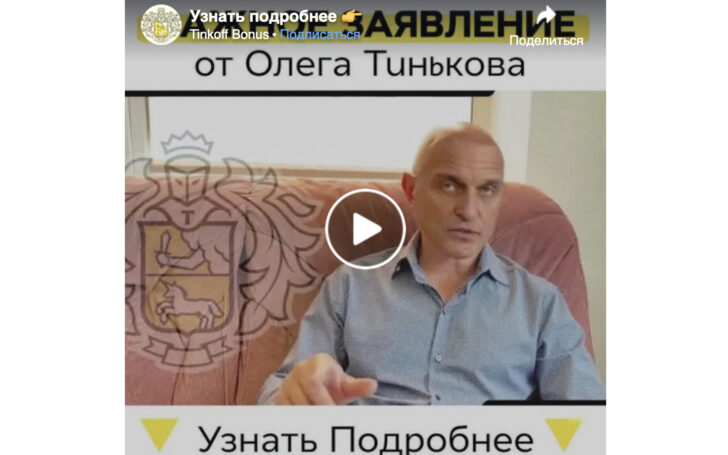

Давайте бегом за бонусом. Мы дарим 50% к вашей сумме вложений. Например, вы инвестируете 20 тысяч рублей, а на счет для работы получаете 30 тысяч рублей

Как научить искусственный интеллект распознавать ложь и чем нейросети, понимающие обман, отличаются от детектора лжи? Эксперт Марина Чурикова

Если бы эта новость не была опубликована таким авторитетным изданием, как РИА-Новости, то я не поверил бы в этот абсурд с розыгрышем парламентариев Нидерландов

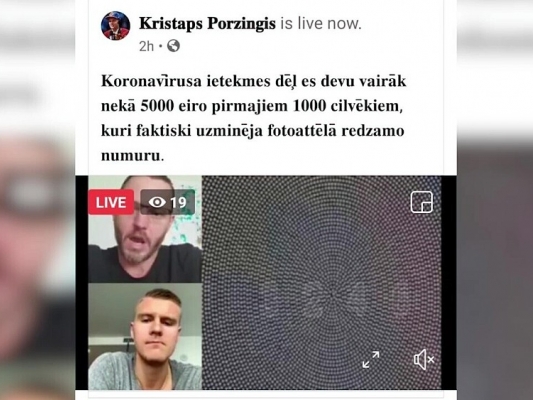

Недавно пользователей социальной сети Facebook удивило обращение, в которых обещалось по 5 000 евро за выигрыш в викторине от знаменитого баскетболиста

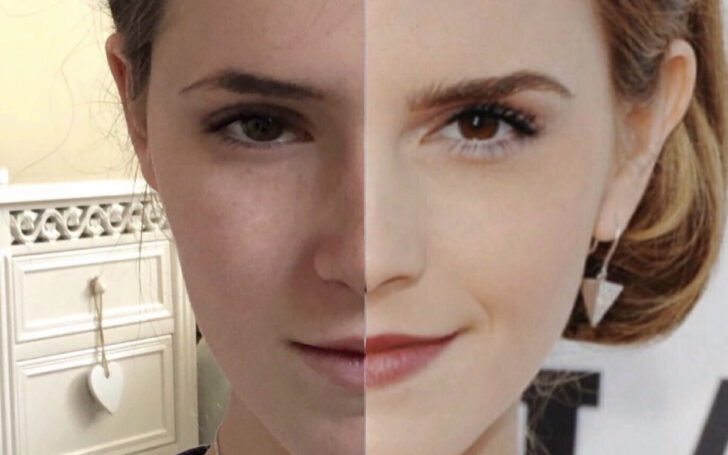

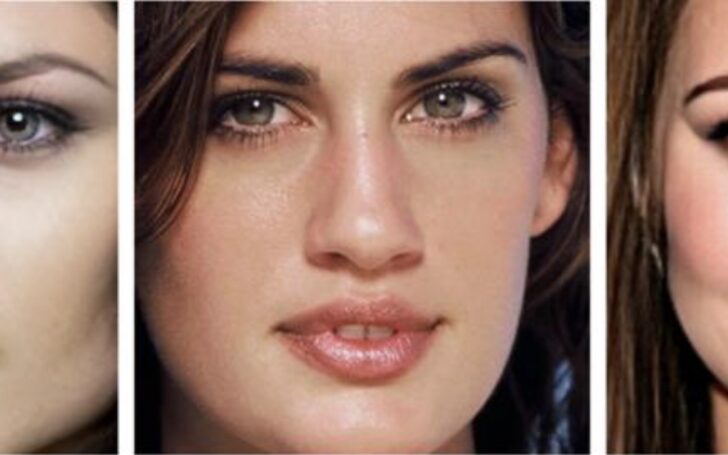

Элла говорит, что на улице ее часто принимают за Эмму. «Мне с детства говорят, что я похожа на Эмму, но я никогда не думала об этом всерьёз, пока люди из Инстаграма и пользователи Reddit не убедили меня в том, что я двойник известной актрисы», – рассказывает Элла Нортон

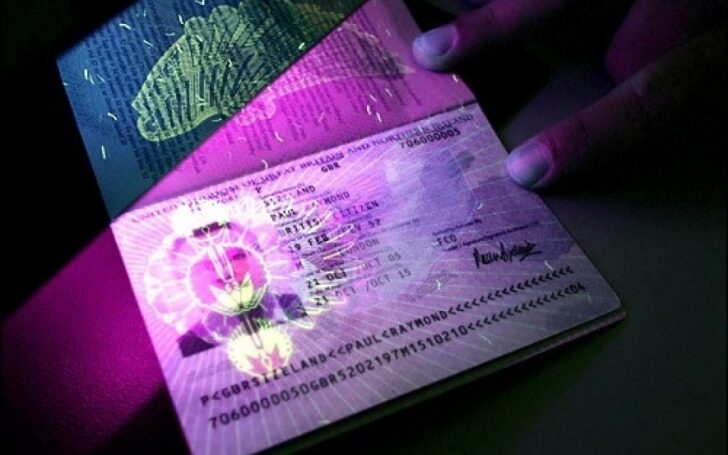

В новом отчете Secure Identity Alliance о мошенничестве с паспортами говорится о уязвимости проездных документов, даже биометрических паспортов

Технологии позволяют мошенникам, имея образец голоса (хотя бы несколько минут речи), записать абсолютно любой текст и использовать его в своих целях

Владелец токийского магазина создает уникальные маски. Вся идея заключается в том, что прототипом для них являются лица реальных людей

За неделю в территориальные подразделения УМВД России по Приморскому краю обратились 74 гражданина, ставших жертвами дистанционного мошенничества

Не удивительно, что в этот фейк поверили. В статье приводятся конкретные имена мошенников. Но, есть несколько аргументов, которые кричат, что это фейк

Детекторы дипфейков не всегда справляются с выявлением подделок. Если дипфейки первого поколения выявляются с вероятностью 100%, то в случае второго поколения диапазон ошибки составляет от 15 до 30%

Раффаэла Мари Споне была арестована в начале марта по обвинению кибер-домогательства к детям. Она была освобождена при условии, что явится на предварительное слушание 30 марта. Не было никакой информации о том, что она наняла адвоката, и попытки связаться с ней по телефону или электронной почте не увенчались успехом

Отличить реальную запись от подделки становится всё сложнее и сложнее. Сейчас, чтобы это сделать – приходится приложить не мало усилий. Рассмотрим это на текущем примере:

Способом борьбы с фейками для Clubhouse могла бы стать метка подтвержденного аккаунта и включение на уровне приложения идентификации, защищающей от подделки голоса с помощью технологий голосовой биометрии. Для получения такой метки соцсеть может обязать пользователя оставить «слепок голоса», а на уровне самого приложения создать голосовую биометрию, которая будет определять, что говорящий соответствует цифровому слепку и голос не является воспроизведением с ноутбука или диктофона

Редактирование отдельных элементов на видеозаписи требует покадровых изменений. Обычно это делается вручную, как в мультипликации, или с использованием специальных инструментов, которые имеют ограниченный функционал и могут выполнять только отдельные запрограммированные действия. Команда разработчиков Google и Оксфордского университета смогли разделить каждый кадр видео на отдельные слои и научила ИИ распознавать в них людей или другие движущиеся объекты

Сейчас мы входим в мир нулевого доверия. Никому и ничему в этом мире нельзя доверять, не увидев подтверждение в виде криптографической цифровой подписи

Мутные воды лжи накрыли континент правды: всемирный потоп повторился в 2016 году, когда объём искажённых сведений впервые превысил интернет-достоверность.

Дмитрий Мацкевич известный в России предприниматель, и вряд ли станет связываться с мошенниками. Вероятно, эти видео были созданы мошенниками при помощи deepfake. Держитесь подальше от тех, кто предлагает быстрые заработки. Если кто-то знает, как можно ежегодно увеличивать своё состояние на 360%, то он должен хранить этот секрет в тайне, а не обесценивать его, привлекая сотни новых конкурентов

В 2020 году появилось несколько новых способов обмана с использование сгенерированных данных. Для этого мошенники подделывают как голоса, так и манеру речи

Ещё вчера все говорили про опасность алгоритмов, генерирующих поддельные изображения и голос. Обсуждалась возможность использования этих алгоритмов в конструктивных целях. Но такие алгоритмы уже вчерашний день. 2021 год ознаменуется появлением более опасных алгоритмов: алгоритмов, которые понимают причину тех или иных действий и подстраиваются под наше психологическое восприятие. Социальная инженерия автоматизируется и ставится на поток

В пресс-центре МВД России сообщили, что с начала года полиция возбудила 37 уголовных дел за распространение фейковой информации о коронавирусе и более 450 протоколов об административных правонарушениях, передает ТАСС