В социальной сети Facebook распространяется манипулируемое видео с лицом и голосом премьер-министра академика Николая Денкова

Рубрика: Политика

Будет очень сложно для избирателей отличить реальное от поддельного. И можно представить, как сторонники Трампа или Байдена могут использовать эту технологию

Microsoft поступила по-хитрому – она не стала прямо говорить, что россиянам входа нет, а решила намекнуть на их невнимательность

Аккаунты вроде WarMonitors, BloombergFeed и RT опубликовали фотографию с большим облаком дыма, поднимающегося рядом с правительственным зданием

Методика синтеза изображения позволяет с лёгкостью создавать огромные объёмы контента, нужно лишь, чтобы сотрудники штаба продолжали уделять этому время

Стартап DeepBrain из США, специализирующийся на синтезе речи, видео и обработке естественного языка представил цифрового двойника южнокорейского политика

Запрещать и не пущать» в случае фейков и дипфейков – абсолютно проигрышная стратегия. Хотя в ряде развитых стран уже прорабатывается законодательная база

Рекламное видео о выборах в Госдуму, в котором при помощи Deepfake использовали лица главы МИД России, российского МО и главврача больницы в Коммунарке

Если бы эта новость не была опубликована таким авторитетным изданием, как РИА-Новости, то я не поверил бы в этот абсурд с розыгрышем парламентариев Нидерландов

С развитием технологий взлома нам нужно доказать еще одно — «мои характеристики предъявляю я сам». Для этого используются liveness detection

Если подготовка этого материала велась профессионалами, то обычные средства выявления подделок не смогут их обнаружить. Но есть большое сомнения, что здравомыслящий политик, не желающий конфронтации между двумя странами, мог сделать такое заявление

Реклама с виртуальными моделями, цифровые телеведущие и фейковые речи президентов – реальность, которую формируют алгоритмы машинного обучения. В 2020 году технологии искусственного интеллекта глубже проникают в сферы телекоммуникаций, развлечений и формируют новые рынки. За развитием дипфейков внимательно наблюдают специалисты по кибербезопасности, расследуя новые формы мошенничества с использованием передовых технологий

Новое поколение уже променяло свободу на возможность играть в компьютерные игры. Цифровые аватары нашим детям зачастую дороже собственных физических тел

Риск COVID-19 в США, где на данный момент коронавирусной инфекций заражены более 2,6 млн человек, удерживает людей от посещения избирательных участков, как это сделал испанский грипп на выборах столетие назад

«Воскрешённый» Хоакин рассказывает, что его убили два года назад, а грядущее голосование могло стать первым в его жизни, но его лишили возможности что-то выбирать

– Объективно для точности распознавания хотя бы на 60-70% необходимо, чтобы алгоритмам системы нейронного обучения было видно для обработки как минимум 50% лица.

В ролике Трампа играет похожий на него актер. Для реалистичности использована технология deepfake, когда изображение или видео накладывается и адаптируется под голос или действия другого человека. Перед разработчиками не ставили задачу сделать героя ролика похожим на Трампа, чтобы не вводить в заблуждение читателей

Страх перед глубокими подделками достиг своего пика. НАТО провела онлайн-дискуссию об угрозе, которую представляют реалистичные, но сфабрикованные видео

Атака дипфейков на нашу реальность. В Интернете более 14 000 поддельных видеороликов, которые посмотрели минимум 134 млн. раз. 96 % – это фильмы для взрослых, куда нейросеть “приклеила” лица актеров, политиков и других известных персон.

С 5 марта Twitter начинает удалять фейковые видео и фото или помечать их соответствующим образом. Facebook будет отличать deepfake-изображения

Дипфейки используют лица не только звезд мира культуры, но и ведущих мировых политиков. И это уже вообще не шутки. Еще в апреле 2018 г. привлек внимание к этой проблеме актер и режиссер Джордан Пил. Для пущей наглядности он сам выступил в дипфейк-ролике, где под видом 44-го президента США Барака Обамы предостерег от опасности дипфейковых новостей. “Мы вступаем в эру, в которой наши враги могут заставить любого сказать что угодно и когда угодно”, – объявил дипфейковый “Обама”.

С помощью технологии дипфейков можно сделать много смешных видеороликов. В большинстве из них известные личности говорят какие-то глупости

В Сети появилось видео, на котором запечатлён момент уничтожения ЗРПК «Панцирь-С», который, по утверждению главы Министерства обороны Турции, якобы был «обезврежен» в Сирии. Тем не менее, как оказалось, в действительности, видео не имеет ни малейшего отношения к Сирии, поскольку оно было сделано на территории Ливии несколько месяцев назад.

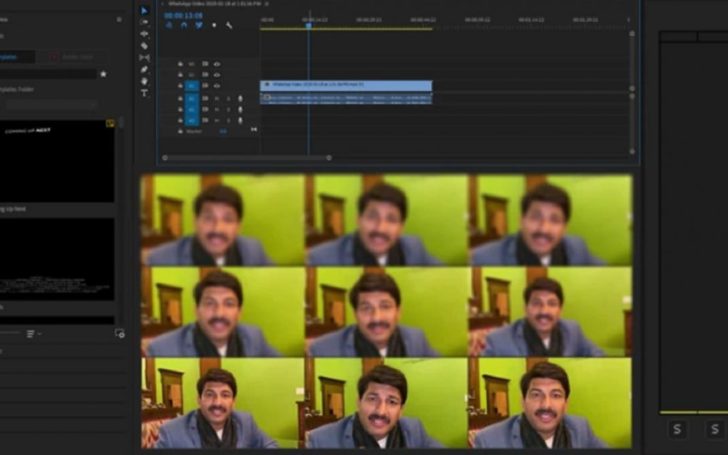

Индийский политик Маной Тивари (Manoj Tiwari) использовал технологию «deep fake» собственного ролика на диалекте ханиани и на английском языке для предвыборной агитации.