Крайне важно разработать руководящие принципы для онлайн-платформ и сайтов социальных сетей по обнаружению и оперативному удалению поддельного контента

Рубрика: Безопасность

Мошенники могут имитировать голос или изображение определённого человека, например, руководителя компании, для кражи денег или конфиденциальных данных

Согласно отчёту Onfido, в 2023 году число попыток мошенничества с использованием дипфейков выросло в 31 раз по сравнению с прошлым годом

Менее 1/3 пользователей имеют представление о том, как определить deepfake – об этом свидетельствуют результаты теста по медиаграмотности

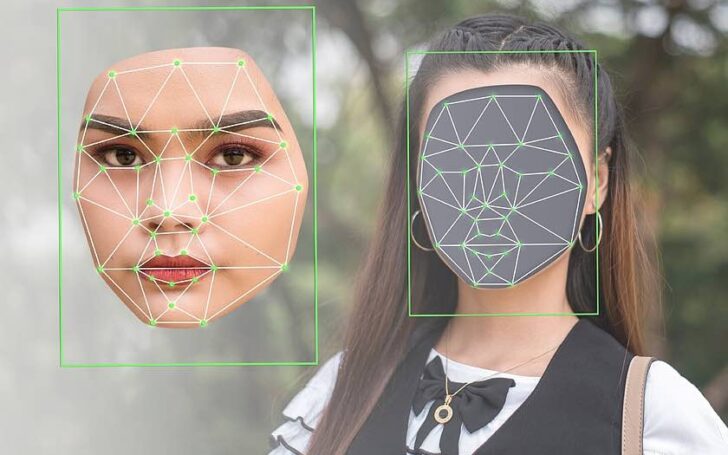

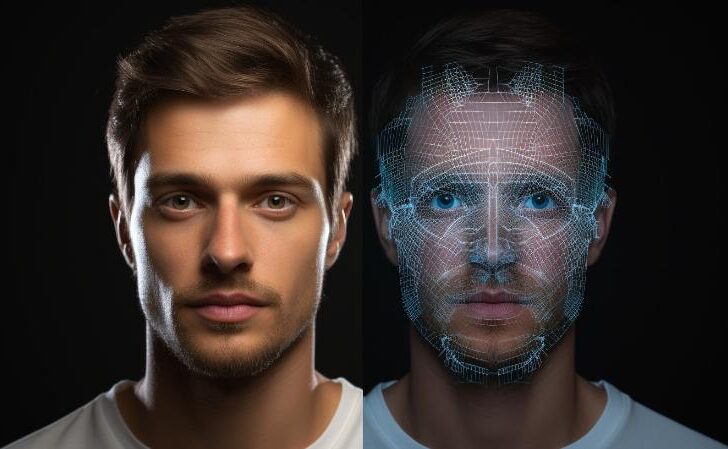

простых способов определить, что видео является дипфейком, — проверить форму лица. Сложнее всего ИИ удаются уши, обычно они оказываются непропорциональными

Если правительства будут оценивать и решать проблемы ИИ независимо и с обычной для них скоростью, то вмешательство дипфейков быстро станет неактуальным

Технологии биометрической идентификации набирают популярность среди компаний, стремящихся обеспечить быстрый и надёжный процесс аутентификации

Предыдущая версия программного обеспечения FaceIO для предотвращения подделок включала активный процесс обнаружения живости

Создавать глубокие подделки стало намного проще с запуском генеративного искусственного интеллекта, основанного на больших языковых моделях

Эксперты по защите детей заявляют, что не могут противостоять тысячам «изображений сексуализированного насилия над детьми, созданных искусственным интеллектом»

За этот год искусственный интеллект (ИИ), особенно ChatGPT и Bard, получил широкое освещение благодаря их способности генерировать широкий спектр результатов

Использованию искусственного интеллекта в деятельности киберпреступников мало поднимается в открытой прессе и мало кто из специалистов пока задумывается о ней

В статье, опубликованной в британском издании, говорится, что местные законодатели намеренно игнорируют опасности, исходящие от глубоких подделок

Tech5 запустила функцию цифровой безопасности с использованием биометрических данных для защиты от подмены изображения лица на печатном документе

2023-й год ознаменовался собой активной кампанией исследователей и учёных, которые заявили, что мир ещё не готов к искусственному интеллекту

С технической точки зрения, VoiceHub 2.0 опирается на возможности ChatGPT для включения новой функции «Обозреватель задач»

В исследовательском отчёте Recorded Future говорится, что голосовое клонирование способно обойти многофакторную аутентификацию по голосу в дикой природе

Deepfake-мошенничество в Китае вызывает всё большие опасений относительно возможности хакеров легко получать финансовую информацию с использованием ИИ

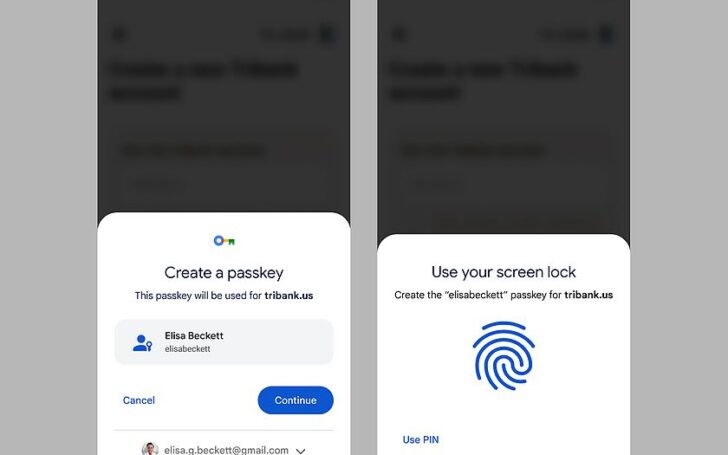

По данным консультанта Zippia, данные примерно трети американцев ежегодно подвергаются взлому, в основном из-за небезопасных имен пользователей и паролей

Технология Passkeys представляет собой альтернативу традиционным паролям и кодам в СМС, рассылаемым при использовании концепции двухфакторной аутентификации

Командование специальных операций США (SOCOM) намерено использовать технологию Deepfake в рамках военных наступательных операций

Эксперты и прочие люди, тесно знакомые с Deepfake, уже активно выступают против планов правительства США использовать эту технологию в своих кампаниях

В 2022 году мобильные абоненты в глобальном масштабе потеряли приблизительно $53 млрд из-за телефонного мошенничества и нежелательных звонков

Киберпреступники применяют возможности ИИ, для того чтобы повысить достоверность текстов, автоматизировать процесс и повысить вероятность обмана пользователей

Работа по стандартизации продолжается, как и усилия по донесению этих стандартов до сообщества, рассказывает доктор Кристоф Буш