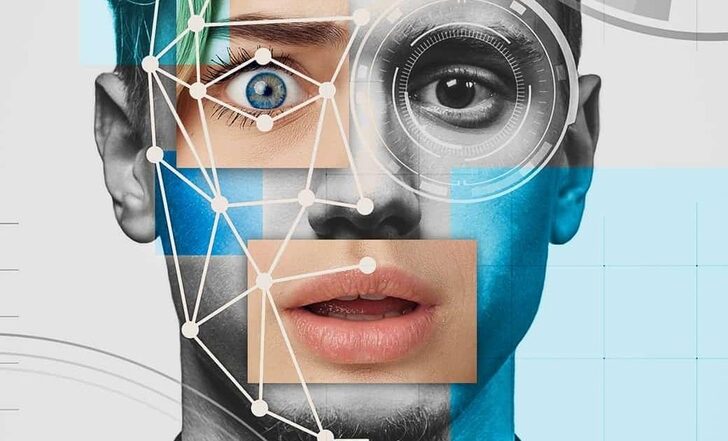

Видеоролики deepfake привлекли к себе пристальное внимание благодаря своему потенциалу в качестве инструментов мошенничества

Рубрика: Безопасность

Учёный Пермского Политеха рассказал о современной технологии, которая позволяет манипулировать аудио- и видеоконтентом, и, как защитить себя и свою репутацию

Наблюдательное агентство Министерства труда по меньшей мере 163 миллиарда долларов США переплат по безработице в рамках программы Covid

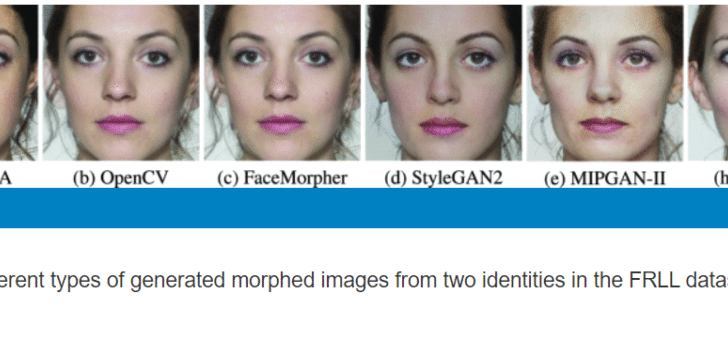

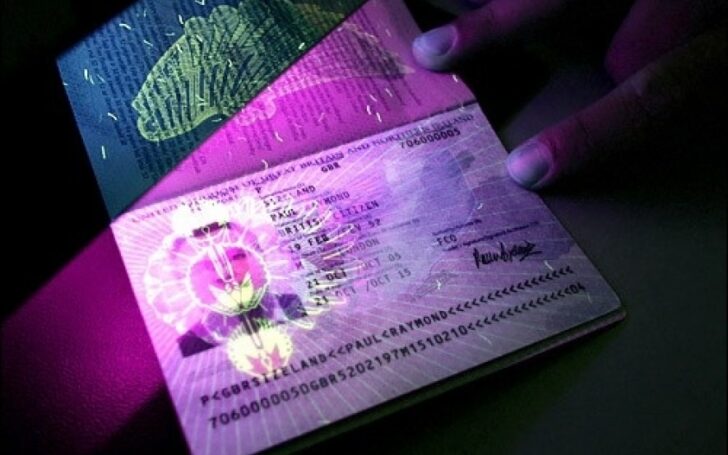

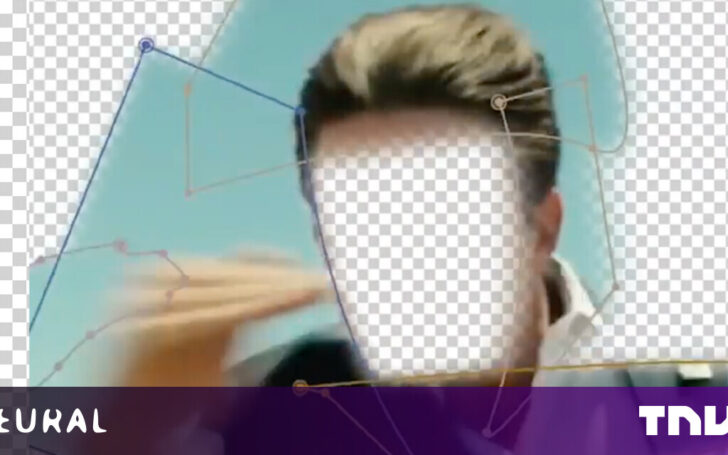

В статье есть инструменты для нейтрализации атак с изменением лица, которые используют измененное биометрическое эталонное изображение в документе

Российское общество, которое до сих пор воспринимает политику и инновации как непересекающиеся прямые, может ждать изрядный сюрприз

Модель г-на Вана с точностью 98,53% отличала настоящие клипы от тех, в которых лица, голоса или и то, и другое были обработаны цифровым способом

«Сбер» планирует использовать их при защите от кибератак, для борьбы с фейковыми новостями и защиты переговоров по видео-конференц-связи

Правоохранительные органы Европейского Союза говорят, что законодателям и регулирующим органам необходимо активизироваться сейчас

Правительство Германии запрещает морфинг паспортных фотографий для присвоения нескольких личностей одной паспортной фотографии для обмана AI

Языковые модели можно настроить так, чтобы они выдавали варьирующиеся тексты на заданную потенциальными злоумышленниками тему

Учёные разработали систему, генерирующую тихие звуки, которые можно включить, чтобы заблокировать умным устройствам возможность подслушивать пользователей

Лаборатории тестирования биометрии также включают Idiap в Швейцарии, TÜViT в Германии и французские лаборатории Fime, Elitt и Leti

Исследователи утверждают, что атаки на фото (или печать) и видеоповтор являются наиболее распространенными атаками, обнаруживаемыми «в дикой природе»

Технология малоизучена, как с точки зрения её работы, так и с точки зрения того, что работает хорошо, а какие виды подделок по-прежнему трудно обнаружить

Агентам ЦРУ и разведок других стран уже недостаточно парика и поддельных документов — нужно помнить о биометрии, распознавании лиц и «цифровом следе» в сети

Даже если обработанные видеоролики кажутся нереальными для людей, они все равно могут обойти текущий механизм обнаружения дипфейков

Как сообщает Unite.AI, тест биометрических API-интерфейсов показывает, что они не справляются с задачей обнаружения новых и развивающихся дипфейков

Главное отличие ИИ от других компьютерных систем — отсутствие предопределенности: ИИ может выдавать разные реакции на одни и те же входные данные

Франк и Шенхерр утверждают, что у них могут быть хорошие шансы на то, что результаты будут перенесены на те же типы данных, которые использовались при атаках

Чтобы повысить осведомленность об опасности дипфейков в корпоративной сфере, Attestiv недавно опросил американских бизнес-профессионалов об угрозах их бизнесу

Технологии по своей сути не являются ни хорошими, ни плохими – это просто инструмент. Да, Дипфейки можно использовать для распространения дезинформации

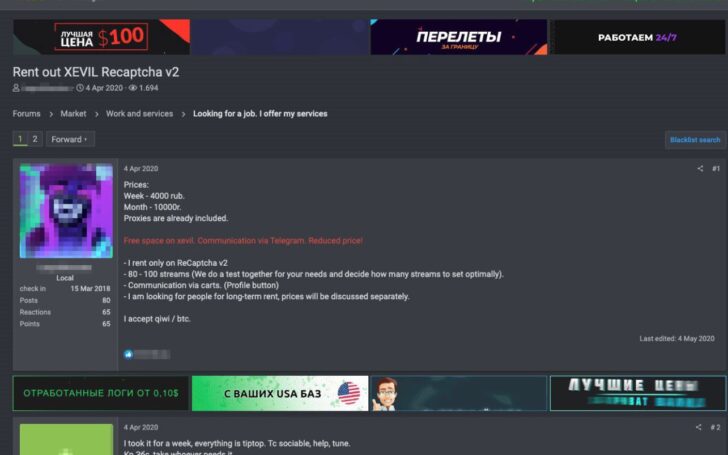

Лёгкий доступ к инструментам для создания DeepFake несёт угрозы разного типа. Это не только распространение фейковых новостей, шантаж или финансовые потери

Как пояснили в Минцифры, система мониторинга позволит своевременно начинать расследования и реагировать на утечки данных и компрометацию информационных систем

Двухфакторная аутентификация уже не так эффективна, как раньше, предупреждают исследователи из Stony Brook University и Palo Alto Networks

В постоянном стремлении к комфорту человек развивает цифровую среду, не задумываясь об её уязвимости. Ждет ли нас цифровая Фукусима?