Люди теперь проводят большую часть своей жизни в интернете, в котором аккумулируется огромное количество информации, и их деятельность в сети может создавать и разрушать репутацию человека. Такая информационная онлайн-среда идеально подходит для занятия преступной деятельностью, основанной на искусственном интеллекте

Рубрика: Безопасность

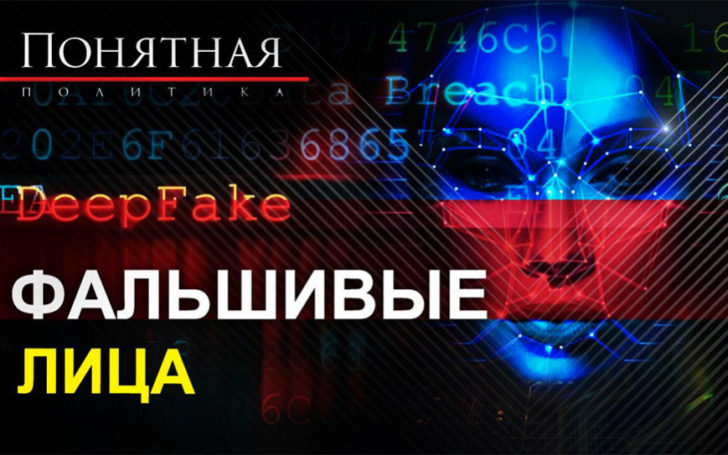

Реклама с виртуальными моделями, цифровые телеведущие и фейковые речи президентов – реальность, которую формируют алгоритмы машинного обучения. В 2020 году технологии искусственного интеллекта глубже проникают в сферы телекоммуникаций, развлечений и формируют новые рынки. За развитием дипфейков внимательно наблюдают специалисты по кибербезопасности, расследуя новые формы мошенничества с использованием передовых технологий

Для будущих публикаций проблема теоретически будет решена, но остается проблема архивов: защищая только вновь создаваемый контент – это не окажет практически никакого влияния на уже размещённые материалы

Знаете ли вы, что она позволяет любому человеку сделать лицо знаменитости? Эксперты считают, что deepfake может быть опасным оружием в информационных войнах

Приведем смысловую выжимку из острой и насыщенной дискуссии, состоявшейся на секции «Цифровая инфраструктура, технологии искусственного интеллекта и вопросы информационной безопасности в банковской сфере» в рамках ИНФОФОРУМ-2020 В дискуссии участвовали такие эксперты отрасли, как Валерий Комаров, начальник отдела обеспечения осведомленности Управления…

Нейросеть меняет изображение по желанию заказчика, и, скажем, обычный продавец на видео выглядит, как президента США Дональда Трампа

Команда DeepMind приобрела известность как разработчик алгоритма AlphaStar, гроссмейстера шахмат, го, сеги, а также 57 классических игр Atari и стратегической многопользовательской игры StarCraft II.

Новое поколение уже променяло свободу на возможность играть в компьютерные игры. Цифровые аватары нашим детям зачастую дороже собственных физических тел

Оценивая угрозы на основе потенциального вреда, прибыльности, жизнеспособности и поражения, группа определила, что deepfake, технология, которая уже существует и распространяется, представляет наивысший уровень угрозы

Риск COVID-19 в США, где на данный момент коронавирусной инфекций заражены более 2,6 млн человек, удерживает людей от посещения избирательных участков, как это сделал испанский грипп на выборах столетие назад

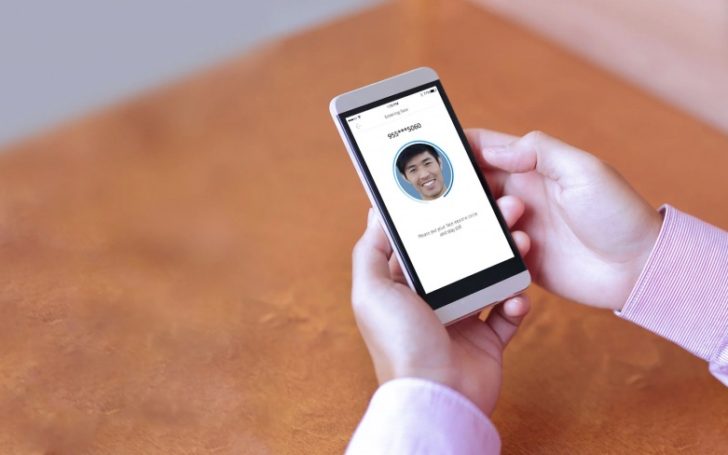

Компания Acuant, ведущий мировой провайдер проверки личности, объявила, что Acuant FaceID обеспечивает распознавание лиц с технологией определения живости

Киберпреступники взяли на вооружение так называемые «русские», «зашифрованные» или «белые» SIM-карты, позволяющие им менять телефонные номера и искажать голос звонящего. Неизвестный звонок поступил из Франции. Когда я взял трубку, мужчина спросил, работал ли я с Национальным агентством по борьбе с…

В ходе аудита сетевой безопасности в 2019 году компания Acronis, специализирующаяся в области кибербезопасности, обнаружила критические уязвимости в устройствах

С каждым годом создавать фейки становится всё проще. Например, уже сегодня можно смонтировать видео якобы со скрытой камеры, где человек признается в чём угодно

Мы ожидаем, что методы создания синтетических медиа будут продолжать совершенствоваться. Мы должны понимать и быть готовыми реагировать на дипфейки

Уязвимость в системе безопасности, обнаруженная Apple в биометрических функциях Touch ID или Face ID в феврале, могла допустить неавторизованный доступ к iCloud

Кража личных данных является одним из наиболее быстро растущих преступлений в США, в последние годы личность миллионов людей была скомпрометирована. В 2019 году Федеральная торговая комиссия получила 3,2 миллиона сообщений о проблемах защиты прав потребителей. Из них наиболее распространенным мошенничеством, о котором сообщалось, были мошенничества и кража личных данных, особенно в государственных службах, онлайн-магазинах и кредитных бюро.

«Мы используем ИИ для подтверждения подлинности личности, проверяя подлинность фотографии на удостоверение личности, а затем сопоставляя его с лицом. Поскольку мы видим десятки миллионов документов, удостоверяющих личность, наш ИИ может выявлять, какие из них являются мошенническими, а какие – нет. Все наши клиенты получают выгоду от этой обновленной и улучшенной модели искусственного интеллекта».

Видео интервью с победителем Deep Fake Detection Challenge Селим Сефербековым.

Селим рассказывает о технических шагах к достижению победы.

Атака дипфейков на нашу реальность. В Интернете более 14 000 поддельных видеороликов, которые посмотрели минимум 134 млн. раз. 96 % – это фильмы для взрослых, куда нейросеть “приклеила” лица актеров, политиков и других известных персон.

Пассивная лицевая биометрическая технология обнаружения живости от ID R&D была внедрена новатором цифровой интеграции Zenoo для усиления безопасности во время онлайн-проверки личности без дополнительных шагов или сложностей

Компания Zoloz подтвердила соответствие уровню 1 и уровню 2 для обнаружения атак презентации (PAD) в соответствии со стандартами ISO 30107-3 для своей биометрической технологии при тестировании на iBeta, объявила компания.

Американский режиссёр показал, какой маской защищается от коронавируса, и от этого зрелища у многих голова идёт кругом. У мужчины очень искажена нижняя часть лица — но это не травма, а творческий подход. И теперь одни люди шутят о том, на кого он стал похож, а другие — делятся своими шедеврами.

С 5 марта Twitter начинает удалять фейковые видео и фото или помечать их соответствующим образом. Facebook будет отличать deepfake-изображения

Глубокие фейки (deepfake; дипфейк) – технологии искусственного синтеза человеческого изображения на основе нейросетей и искусственного интеллекта. С помощью технологии одним из первых был создан ролик «Вы не захотите поверить тому, что Обама скажет в этом видео», в котором бывший президент…