Техническое медиа Ferra.ru, входящее в состав Rambler Group, первым среди российских СМИ интегрировало в свои новости диджитал-телеведущую Елену от SberDevices

Рубрика: Голос

В рамках международной программы инновационных проектов Фонда «Сколково» «Глобальный вызов – искусственный интеллект для целей устойчивого развития (ЦУР)» объявлена специальная номинация от компании Тинькофф, официального партнера конкурса.

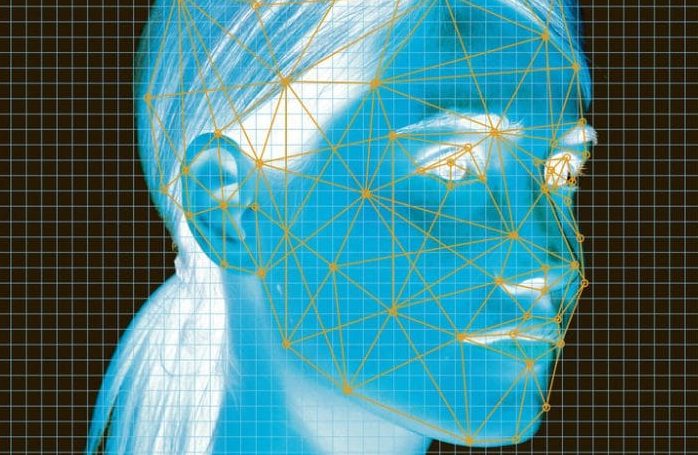

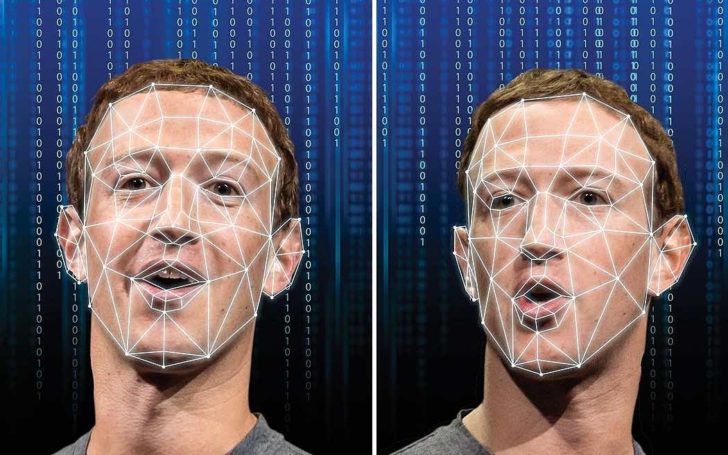

Кража личных данных является одним из наиболее быстро растущих преступлений в США, в последние годы личность миллионов людей была скомпрометирована. В 2019 году Федеральная торговая комиссия получила 3,2 миллиона сообщений о проблемах защиты прав потребителей. Из них наиболее распространенным мошенничеством, о котором сообщалось, были мошенничества и кража личных данных, особенно в государственных службах, онлайн-магазинах и кредитных бюро.

С начала года появилось сразу несколько новых систем ИИ, способных синтезировать видеозапись с говорящим человеком на основе аудио. Расскажем, кто и с какой целью занимается подобными разработками. Также поговорим о других инструментах, позволяющих редактировать аудиозаписи.

Компания Aculab представила новую версию голосовой биометрической системы VoiSentry для центров обработки вызовов, в которой реализован расширенный функционал обнаружения атак презентации (PAD)

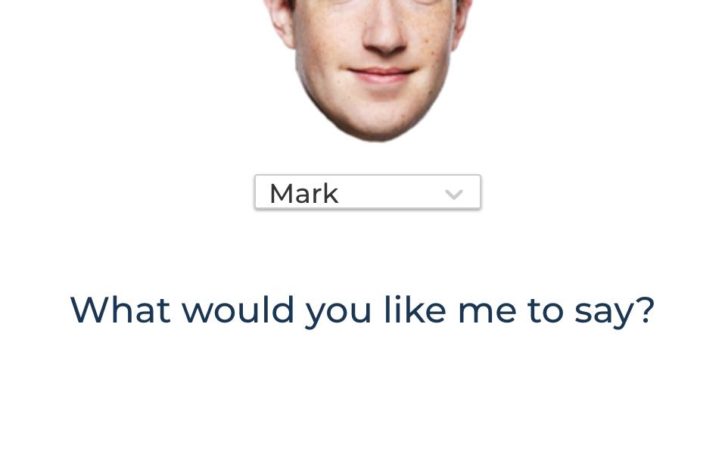

Приложение преобразовывает текст на английском языке в речь и затем предлагает создать видео. Оно работает на базе Microsoft Custom Voice.

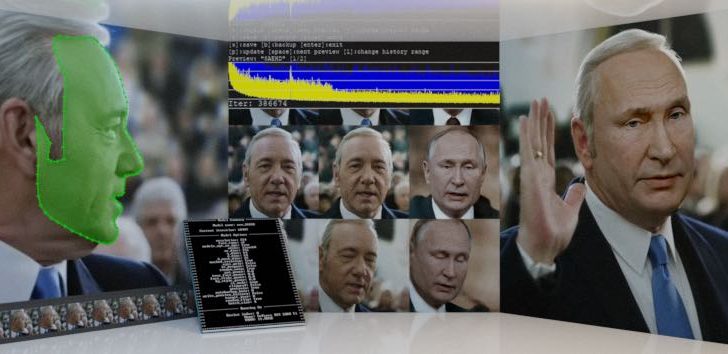

DeepFaceLab — это опенсорсная система для создания дипфейков. Репозиторий проекта имеет 4 тысячи форков и 18 тысяч звезд на GitHub. Система рассчитана одновременно на пользователей без знаний о фреймворках глубокого обучения и на разработчиков, которые хотят усилить существующий пайплайн.

Как появились, менялись и развивались дипфейки, а также чем они могут быть полезны рекламной индустрии

Mail.ru Group разработала платформу, которая позволяет создавать новостные и репортажные видео с виртуальным диктором, чью внешность создает сам пользователь. Об этом ТАСС рассказали в пресс-службе компании.

Технологический прогресс — дело, конечно, хорошее, ели он служит во благо человечеству. Но часто случается, что судить о том, принесут ли технологии пользу или, наоборот, навредят людям, нам приходится с учетом того, в чьих руках они окажутся. В своей программе «Цифра» на Радио «Комсомольская правда» Александр Тагиров рассказал, что такое дипфейки и можно ли от них обезопаситься.

Атака дипфейков на нашу реальность. В Интернете более 14 000 поддельных видеороликов, которые посмотрели минимум 134 млн. раз. 96 % – это фильмы для взрослых, куда нейросеть “приклеила” лица актеров, политиков и других известных персон.

Reading a text with a synthesized voice is practically no different from reading a person if the text is not very complex.

The following are some examples.

Порнография онлайн привлекает миллионы людей, готовых смотреть на секс. Достаточно ввести запрос в интернет, и вам покажут всё, что пожелаете

Вообще я оживляю исторических личностей нейросетками. Пытаюсь применить дипфейк к чему-то полезному. Очень хочу показать вам проект, и как я его делаю

С 5 марта Twitter начинает удалять фейковые видео и фото или помечать их соответствующим образом. Facebook будет отличать deepfake-изображения

Новостное агентство продолжает экспериментировать с цифровыми телеведущими. Женский коллектив ИИ-журналистов пополнился Синь Сяовэй, разработанной специалистами Sogou. Она является цифровой копией реальной ведущей Чжао Ваньвэй и управляется исключительно текстовым вводом. Новый бот, зачитывающий новости «Синьхуа», стал самой реалистичной копией человека из «работающих» в агентстве и со временем сможет вести репортажи за пределами студии.

Deepfake стал одним из самых спорных явлений в технологической индустрии. Поскольку эта технология представила на рынке сумасшедшую концепцию

Случалось ли вам встречать на улице человека, который один в один был бы похож на вас? Одежда, лицо, походка, манера общения, повадки полностью идентичны вашим. Как будто вас отсканировали и распечатали на принтере. Звучит немного жутковато, не так ли? А теперь…

Дипфейки используют лица не только звезд мира культуры, но и ведущих мировых политиков. И это уже вообще не шутки. Еще в апреле 2018 г. привлек внимание к этой проблеме актер и режиссер Джордан Пил. Для пущей наглядности он сам выступил в дипфейк-ролике, где под видом 44-го президента США Барака Обамы предостерег от опасности дипфейковых новостей. “Мы вступаем в эру, в которой наши враги могут заставить любого сказать что угодно и когда угодно”, – объявил дипфейковый “Обама”.

В 2018 году государственное информагентство Китая Синьхуа продемонстрировало разработку компании Sogou — виртуального телеведущего

Nvidia выпустила софт под названием RTX Voice, плагин анализирует звук с микрофона и убирает из него посторонние шумы, такие как звук вентиляторов, нажатий на клавиши и так далее, оставляя только голос.Работает в Discord, Zoom, Skype, Google Chrome, Steam Chat, OBS и некоторых других программах.

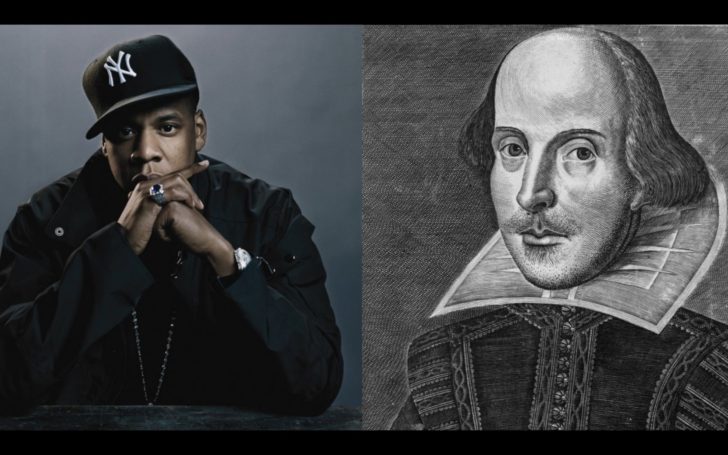

Компания Roc Nation, принадлежащая американскому хип-хоп музыканту Jay-Z, потребовала удалить с YouTube видеоролики с дипфейками, на которых поддельный рэпер читает текст песни «We Didn’t Start the Fire» Билли Джоэла и монолог Гамлета «Быть или не быть». Видеозаписи опубликованы на канале Vocal Synthesis.

С помощью технологии дипфейков можно сделать много смешных видеороликов. В большинстве из них известные личности говорят какие-то глупости

Мэр Лондона Садик Хан поддержал новую технологическую компанию, которая занимается созданием “deep-fake” контентом, основанном на искусственном интеллекте. Деньги от налоговых поступлений пошли на финансирование стартапа под названием Synthesia.

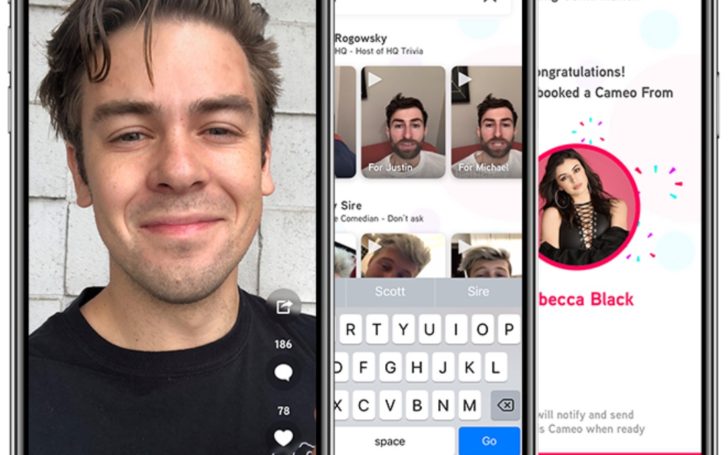

Американский стартап Cameo собрал на площадке больше десяти тысяч звезд и предлагает пользователям их видео-автографы. Когда миллениал хочет сделать подарок другу, он находит в каталоге любимого певца или блогера одариваемого, заполняет короткую форму и платит с карты. Через несколько дней на почту приходит примерно минутное видео, на котором звезда рассказывает, какой Джон клевый, и как у него все будет хорошо.