Исследователи из лаборатории SAND Lab при Чикагском университете утверждают, что доступные программы клонирования голоса развиваются угрожающе быстро

Группа китайских и американских исследователей разработала алгоритм создания дипфейков CihaNet, устраняющий проблему маскировки краев при смене лиц

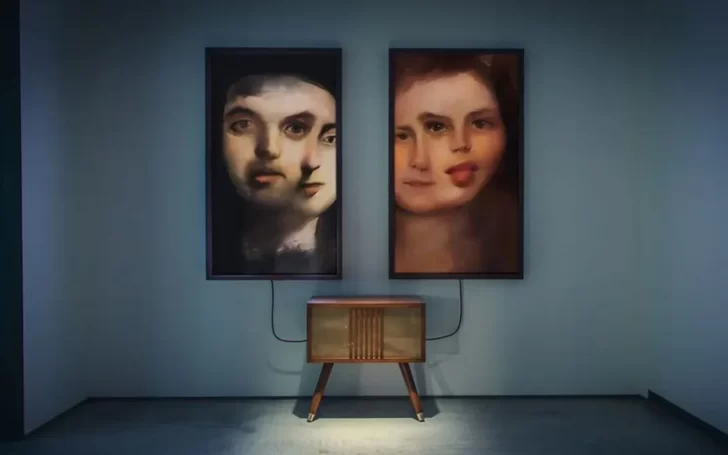

Британская компания Oxia Palus при помощи технологии искусственного интеллекта (ИИ) воссоздала произведение Пабло Пикассо

Редакция американского издания Miami Herald заменила уволившегося журналиста нейросетью. Специализация «корреспондента» — статьи о рынке недвижимости

Компания Microsoft объявила, что внедрит модель обработки естественного языка в облако Azure и разрешит бизнесу пользоваться ИИ-разработками

За неделю с момента релиза ruDALL-E пользователи по всему миру сгенерировали более 3 млн изображений при помощи ruDALL-E, используя системы машинного перевода

Технология «дипфейк» способна «воскрешать» мертвых, комбинировать лица людей с чужими телами, такой возможностью пользуются как в благих целях, так и не очень

Поддельные видео и аудио достаточно развиты — гипотетически, их уже можно использовать для манипулирования мнениями, ценами на акции или чем-то ещё

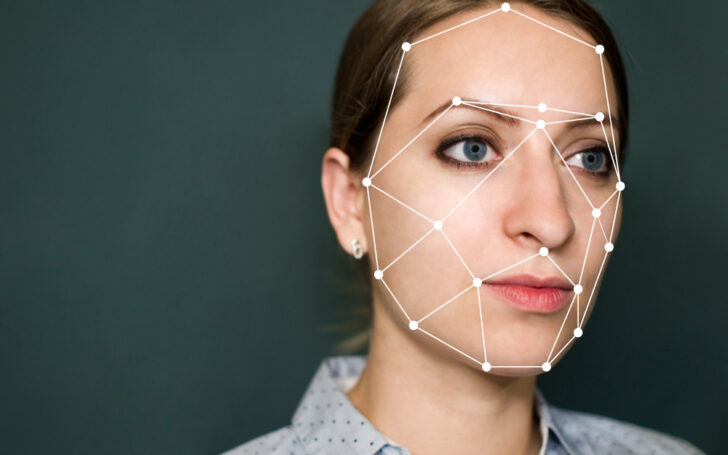

Участницы команды за 2 недели разработали проект в сфере искусственного интеллекта, который с точностью до 99% может распознавать дипфейк-материалы

VisionPass – единственный биометрический терминал на рынке контроля физического доступа, который проходит оценку 1 и 2 уровня обнаружения презентационных атак

Стартап сфокусирован на алгоритме, который может переключать между английским, американским, австралийским, британским, филиппинским и испанским акцентом

Среди трендов, названных агентством Gartner стратегическими для 2022 года, упоминается генеративный искусственный интеллект (Generative Artificial Intelligence)

Насколько генерируемый текст беседы может быть неотличим от реального можно судить по интервью, которое РБК взял у GPT-3 — следующей версии языковых роботов

Соучредители Modulate Майк Паппас и Картер Хаффман изначально думали, что технология может сделать игры более увлекательными

Государства сегодня стремятся противодействовать этому явлению, и фактически мы наблюдаем однозначную позицию – негативную – по отношению к дипфейкам

Поклонники ушедших из жизни звезд мечтают увидеть их снова. Современные технологии позволяют сотворить настоящее чудо и «оживить» любимого исполнителя

Оказывается, что почти десять лет назад атаке подмены лица на порнографических изображениях подверглась наша соотечественница, психолог, Анетта Орлова

Стартап DeepBrain из США, специализирующийся на синтезе речи, видео и обработке естественного языка представил цифрового двойника южнокорейского политика

Кому принадлежат авторские права на контент, созданный нейросетью, и есть ли риск Третьей мировой с участием ИИ — в отрывке из книги Станислава Петровского

дискриминация в алгоритмах искусственного интеллекта по половому и расовому признакам недопустима, хотя и такое наблюдается в некоторых странах

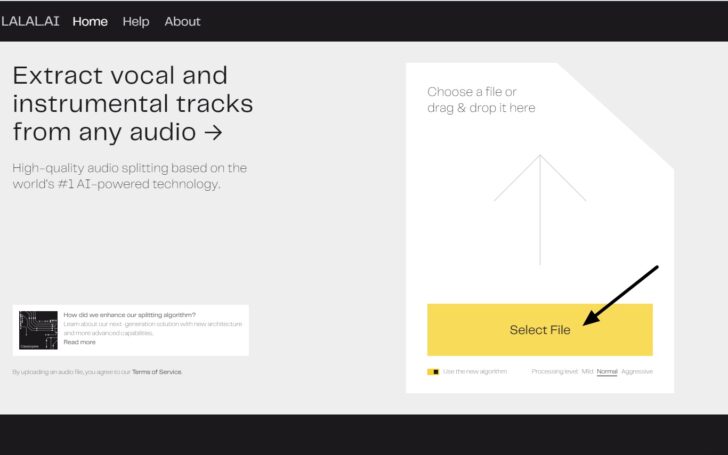

LALAL.AI — это онлайн‑сервис по разделению дорожек любого аудиоформата на вокал и музыку. С таким AI можно дать волю фантазии

Согласно исследованию ID R&D, атаки биометрической подмены легче обнаруживаются компьютерными системами на основе искусственного интеллекта, чем людьми.

Руководитель аналитического центра Zecurion Владимир Ульянов: как простым россиянам защититься от мошенников, использующих технологию deepfake

Данные, которые можно загрузить бесплатно, позволяют приложениям искусственного интеллекта распознавать эмоции во время разговора людей

Копировать кого-то или что-то – это не придумывать новое. Посмотрите видео, в нём говорится, катким будет следующий шаг, после deepfake