Широкий спектр биометрических приложений представлен в главных новостях, посвящённых биометрии, общей темой которых является огромный масштаб

Метка: Deepfake

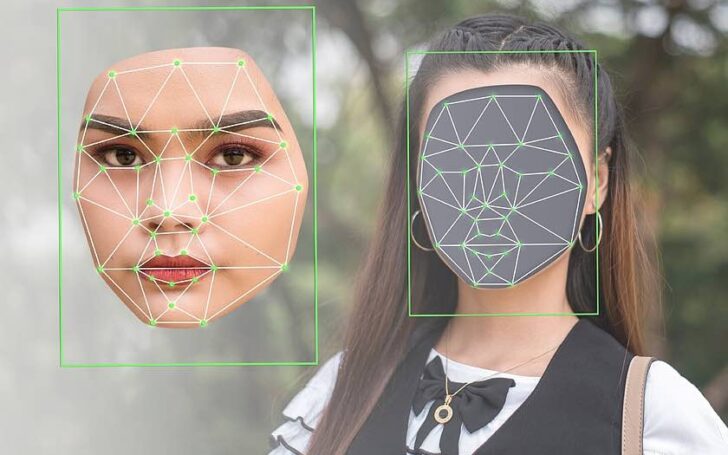

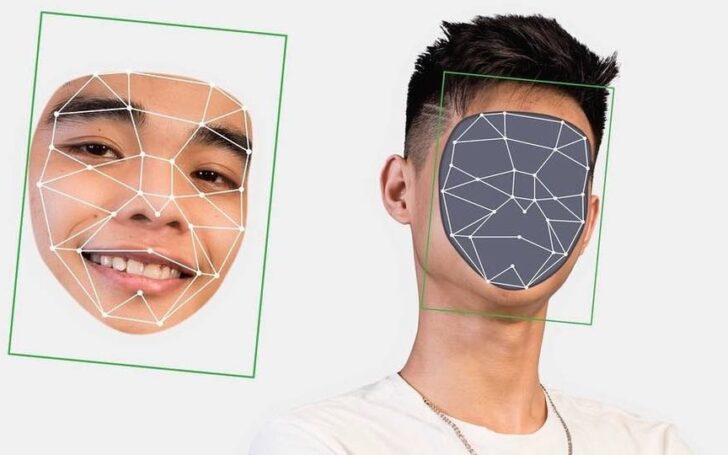

Deepfake – обман систем биометрической идентификации

Существует несколько вариантов использования голосовых дипфейков для совершения мошенничества. Специалисты различают как минимум три наиболее распространённых

Крайне важно разработать руководящие принципы для онлайн-платформ и сайтов социальных сетей по обнаружению и оперативному удалению поддельного контента

Мошенники могут имитировать голос или изображение определённого человека, например, руководителя компании, для кражи денег или конфиденциальных данных

Согласно отчёту Onfido, в 2023 году число попыток мошенничества с использованием дипфейков выросло в 31 раз по сравнению с прошлым годом

Поддельное порно знаменитостей попало в заголовки газет несколько лет назад, но любой, кто изучает биометрию, знает о реальной угрозе гораздо больше

сли предложение кажется слишком хорошим, чтобы быть правдой, скорее всего, это мошенничество. Не позволяйте дипфейкам обмануть вас и лишить вас ваших сбережений

Менее 1/3 пользователей имеют представление о том, как определить deepfake – об этом свидетельствуют результаты теста по медиаграмотности

Дипфейки, использующие искусственный интеллект для манипулирования лицами или телами в видео, в последние годы становятся все более распространенными

Суд отклонил доводы ответчика и постановил, что технология deepfake — «дополнительный инструмент обработки» видео, а не способ его создания

Фальсифицированные видеоматериалы, фотографии и аудиозаписи, созданные с применением технологий искусственного интеллекта наносят серьёзный ущерб гражданам

Закон сделает уголовным преступлением публикацию фотографий откровенного сексуального характера, которые были изменены цифровым способом

Исследователи говорят, что создание реалистичных выражений лица на основе аудиозаписей представляет собой сложную задачу.

Многие не узнают, что их фотографии могли использовать для создания дипфейков. Инициировать расследование или судебное разбирательство таких случаев сложно

Причиной стал скандал, разгоревшийся после того, как стало известно, что в качестве спикеров были заявлены несуществующие докладчики из известных компаний

простых способов определить, что видео является дипфейком, — проверить форму лица. Сложнее всего ИИ удаются уши, обычно они оказываются непропорциональными

Некоторые ИИ-модели работают настолько эффективно, что даже опытным специалистам сложно отличить сгенерированные изображения от реальных фотографий

Полиция Гонконга раскрыла первое дело в этом финансовом центре, связанное с глубокими подделками с целью обмана банков и других кредиторов

Если правительства будут оценивать и решать проблемы ИИ независимо и с обычной для них скоростью, то вмешательство дипфейков быстро станет неактуальным

Эксперты утверждают, что просмотр обучающего видео с Deepfake-ом самого себя, в отличие от видео с участием других людей, облегчает и ускоряет процесс обучения

В Донском государственном техническом университете разработали программу, которая способная выявлять фейковые видео, в которых использована deepfake технология

В случае подозрения, что перед вами визуальный deep fake, старайтесь обращать внимание на качество изображения, движение глаз, цвет кожи и волос, контур лица

Премьера состоится на Гетеборгском фестивале в 2024 году. На специальный показ планируют пригласить как Альму Пёвсти, так и Лив Ульман

Синтетические данные следует осторожно использовать при обучении распознаванию лиц, поскольку он также может быть подвержен потенциальным искажениям

Смена поп-культуры на мемы и отредактированные изображения может привести к сложностям с пониманием того, что реально, а что подделка