Возможность на лету редактировать видеоматериал представляется многим современным пользователям чем-то действительно уникальным и невообразимым

Рубрика: Технология

Microsoft Research в партнерстве с Пекинским университетом опубликовала две академические статьи, в которых обсуждается концепция искусственного интеллекта

Технология дипфейков использует глубокие нейронные сети для убедительной замены на видео одного лица другим. У этой технологии есть очевидный потенциал для злонамеренного использования, и она становится всё более распространённой. По поводу социальных и политических последствий этого тренда было написано уже много хороших статей.

Инженеры Facebook Шон Васкес и Майк Льюис использовали алгоритмы искусственного интеллекта для разработки «умного» синтезатора речи MelNet. Программа сгенерировала голос основателя Microsoft Билла Гейтса и других известных личностей. Аудиоролики длительностью до трех секунд разработчики опубликовали на сайте, посвященном исследованию, в разделе…

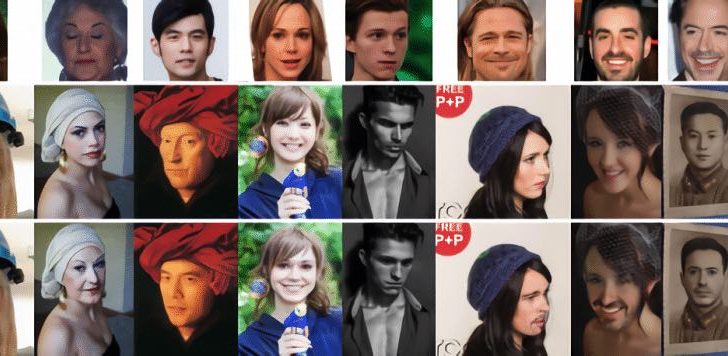

FaceShifter — это двухступенчатый нейросетевой фреймворк для реалистичного переноса лица на изображение человека. Модель устойчива к окклюзии лиц на входных изображениях. Исследователи заявляют, что FaceShifter лучше, чем предыдущие подходы, сохраняют черты целевой личности в сгенерированном изображении.

С помощью нового сервиса Assembler журналисты и исследователи смогут определять, оригинальная перед ними фотография или поддельная. Сервис будет бороться с появлением в сети дипфейков Дочерняя компания Alphabet Inс. (владелец поисковой системы Google) Jigsaw разработала бесплатный сервис Assembler, который позволяет отличить…

С целью стимулировать разработку технологий способных автоматически распознавать “дипфейки”, закон об Оборонном бюджете США (NDAA), подписанный президентом США

Эксперты обеспокоены несовершенством технологий распознавания deepfakes. Речь об этом шла во время очередного заседания проекта “Экспертная среда” – “Deepfakes: новый вызов информационной безопасности” в пресс-центре БЕЛТА. Аналитик Белорусского института стратегических исследований (БИСИ) Виталий Демиров подчеркнул, что воздействие deepfakes и fake…