GDPR ЕС ввел строгие правила для защиты людей и их данных, в противном случае компаниям грозят огромные штрафы. Однако, если данные не могут быть связаны с каким-либо лицом, согласие больше не требуется, и компании могут использовать его по своему усмотрению.

Группа исследователей из Университета науки и технологий в Норвегии представила новый метод на основе ИИ, который якобы анонимизирует лица на изображениях для защиты конфиденциальности пользователей, «при этом первоначальное распределение данных остается непрерывным», пишет Synced.

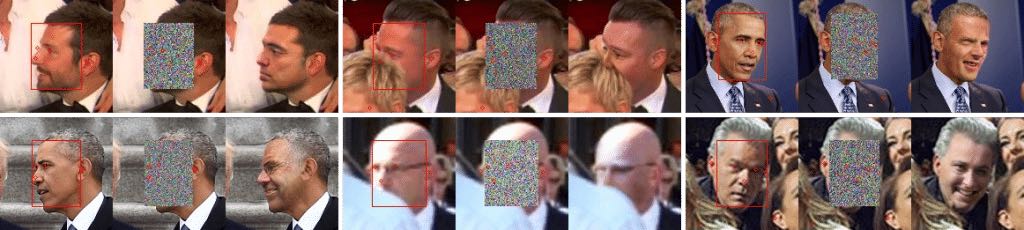

Модель DeepPrivacy представляет собой условную порождающую состязательную сеть (GAN), с помощью которой исследователи хотят стереть конфиденциальную информацию, создавая новое лицо для сохранения визуальной целостности данных. Генератор лица не определяет фактическое лицо человека и создает реалистичное лицо, которое скрывает конфиденциальную информацию о фактических чертах лица. По словам исследователей, модель должна работать с любыми функциями или фоном, и для нее требуется только ограничительная аннотация для обнаружения чувствительных к конфиденциальности функций и разреженная оценка позы (ключевые точки) для достижения дизайна нового лица.

Модель DeepPrivacy основана на наборе данных из 1,47 миллионов человеческих лиц, Flickr Diverse Faces (FDF), который «охватывает значительно большее разнообразие поз лица, частичных окклюзий, сложных фонов и разных людей», – рассказали исследователи Synced.

Модель DeepPrivacy основана на наборе данных из 1,47 миллионов человеческих лиц, Flickr Diverse Faces (FDF), который «охватывает значительно большее разнообразие поз лица, частичных окклюзий, сложных фонов и разных людей», – рассказали исследователи Synced.

Модель анонимизации основана на применении прогрессивного метода обучения к генератору и дискриминатору. Этот метод удваивает разрешение при каждом расширении сети, с 8 до 128 × 128, что делает данные позы более точными с каждым увеличением.

После ряда экспериментов он получил 99,3% от первоначальной средней точности, в то время как другие методы достигли 96,7% (пикселирование 8 × 8), 90,5% (ярко-синий) и 41,4% (затемнение).

Метод объясняется в статье «DeepPrivacy: порождающая состязательная сеть для анонимизации лица», которую можно просмотреть на arXiv; исходный код проекта доступен на GitHub.

Асимметричные позы или запутанные фоны могут привести к искажению изображений, однако, согласно отчету, метод DeepPrivacy доказал свою эффективность в защите конфиденциальности визуальных данных.

D-ID недавно анонсировала новое решение Smart Anonymization для удаления черт лица, используемых для биометрии, а также другой информации, позволяющей установить личность (PII), из видео и неподвижных изображений. В дополнение к блокировке распознавания лиц Smart Anonymization также заменяет номерные знаки данными, генерируемыми компьютером.

По материалам Biometrics Research Group. Автор Luana Pascu.