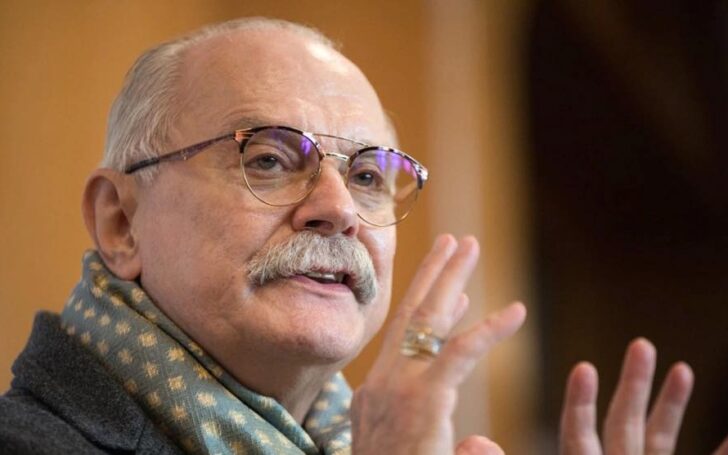

Просмотр с дипфейками знаменитых людей, которые не имели к этому отношения, является «разрушением человеческой сущности, человеческих и семейных отношений»

Метка: Deepfake

Deepfake – обман систем биометрической идентификации

Идею проекта представили на форуме регионального кинематографа «Новый вектор. Сибирь» в Белокурихе. Идею поддержала министр культуры Алтайского края

Deepfake меняет представление о возможностях видеосвязи, но для её положительного воздействие, необходимо участие всех заинтересованных сторон

Несмотря на сложности в определении и борьбе с дипфейками, некоторые российские эксперты предложили внести соответствующих изменений в законодательство

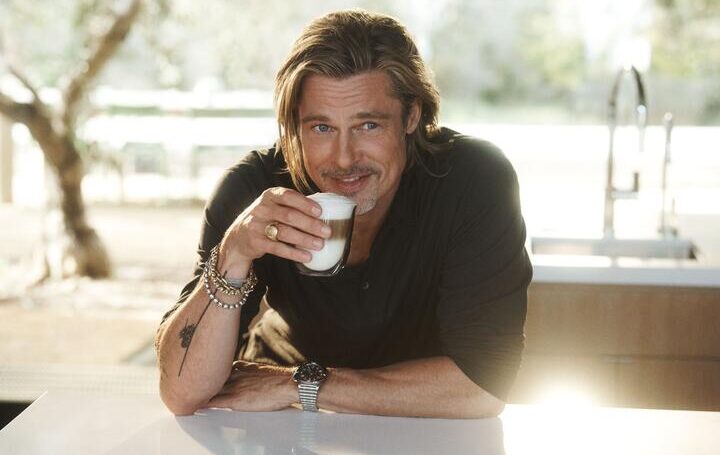

Если рекламодатель и лицо, чей образ используется в рекламе, не заключили соглашение и рекламодатель не получил согласия на такое использование, – это нарушение

«Наносемантика» 9 апреля 2024 года объявила о завершении проекта синтеза голоса известного российского блогера Руслана Усачёва

Член Палаты представителей США Александрия Окасио-Кортез рассказывает об ужасе, который она испытала, увидев себя в «порно-подделке»

Изучение и предотвращение атак с использованием голосовых дипфейков является важной задачей для обеспечения безопасности в цифровой среде

В киберпространстве разгорается скандал, связанный с использованием генеративного ИИ для создания порнографических картинок без согласия изображённых на них лиц

Инструменты искусственного интеллекта применяются для обзвона и выявления потенциальных жертв, что позволяет мошенникам быть эффективнее

Образ Юрия Владимировича Никулина не будет использоваться в рекламных целях – ни на плакатах, ни в трейлерах фильма его не будет

В настоящее время дипфейки выявляют вручную криминалисты и специалисты по информационной безопасности при анализе конкретного видео

Мошенники воспользовались deepfake-технологией замены лиц и голосов. В ходе видеоконференции они выдали себя за руководство головного офиса

Выводы доклада были сделаны на основе дискуссии на тему «Глубокие подделки и демократия», проведённой MediaNama 17 января при поддержке Meta и Google

Многие мечтали о летающих машинках и космических приключениях, но вместо этого мы столкнулись с новыми схемами мошенничества, использующими нейросети и дипфейки

Onfido сообщает об огромном всплеске глубоких фейковых атак, поскольку правительства борются с новыми потенциальными угрозами

Граждане республики также называют детей в честь казахстанских городов. В стране живут 24 Астаны, 20 Алма-Аты и 3 Шымкента

Глубокие подделки потенциально могут нанести значительный вред, распространяя дезинформацию, манипулируя общественным мнением и подрывая доверие

В России дипфейки пока экзотика, но уже сейчас люди и целые компании теряют деньги из-за мошенников, использующих эту технологию. Можно ли себя обезопасить?

Согласно отчету биометрической компании iProov, мошенники все чаще используют инструменты искусственного интеллекта для создания поддельных изображений и видео

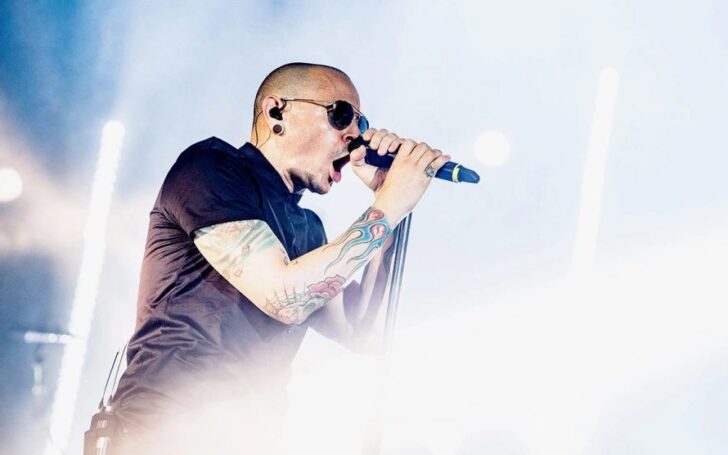

Рок-группа Linkin Park анонсировала выход трека Friendly Fire, записанного при участии покойного фронтмена коллектива Честера Беннингтона

Мошенники применяют разные схемы, чтобы обмануть. Одна из них, когда сотруднику звонит якобы его руководитель и просит срочно сделать перевод или оплатить счет

Минцифры, МВД и Роскомнадзором займутся правовым регулирования цифровой технологии подмены личности. За преступления с использованием дипфейков введут наказание

Различных нейросетей, способных сгенерировать обнажённые изображения, существует немало, однако в центре международного скандала оказалось приложение ClothOff

Группа из 20 ведущих технологических компаний объявила о совместном обязательстве бороться с дезинформацией, полученной с помощью искусственного интеллекта