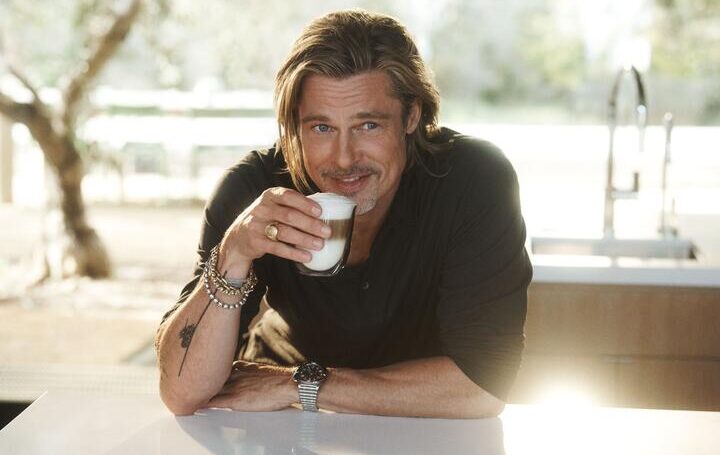

Если рекламодатель и лицо, чей образ используется в рекламе, не заключили соглашение и рекламодатель не получил согласия на такое использование, – это нарушение

Рубрика: Обзор

Причиной стал скандал, разгоревшийся после того, как стало известно, что в качестве спикеров были заявлены несуществующие докладчики из известных компаний

В случае подозрения, что перед вами визуальный deep fake, старайтесь обращать внимание на качество изображения, движение глаз, цвет кожи и волос, контур лица

Китайские технологические гиганты, как Alibaba и Huawei, подали 110 заявок, связанных с технологией deepfake, в китайский регулятор киберпространства

Google активно разрабатывает защиту для пострадавших от несанкционированной порнографии, однако пока что в США нет федерального закона, запрещающего дипфейки

Платформа создаёт анонимизированный биометрический шаблон лица пользователя и может генерировать совпадения с потенциальными донорами менее чем за пять секунд

Атаки Deepfake в различных медиаформатах, таких как изображения, видео, аудио и текст, могут использоваться для влияния на общественное мнение

На волне цифровых преобразований Япония столкнулась с проблемами 130 тысяч Японских идентификаторов в своей системе цифровой идентификации My Number

Распространение подобных сервисов ещё получит свою правовую оценку, но в одном создатели сайта правы: Технология Deepfake уже здесь, и пути назад нет

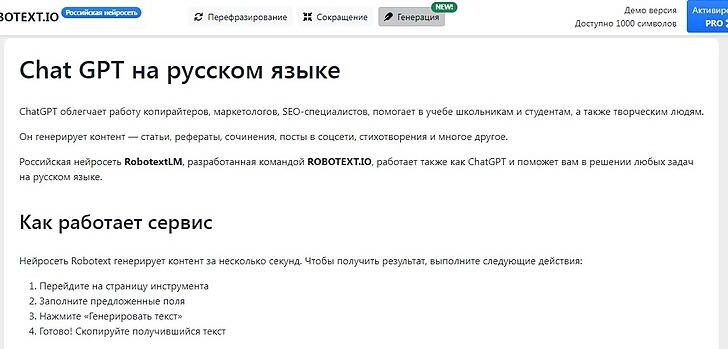

Российская нейросеть RoboText.io уже доступна всем пользователям в браузерах и на мобильных устройствах с бесплатным пробным периодом без регистрации

В статье дан обзор 15 сервисов с нецросетевыми алгоритмами с полностью бесплатным доступом или бесплатными периодами пользования

В Японии с августа 2023 года токийские власти начнут использовать ChatGPT для составления документов и информационных бюллетеней

Если в следующем сезоне вы не увидите новых серий любимого американского сериала, дело, скорее всего, в забастовке Гильдии сценаристов США

В 2022 году венчурные фонды в мире вложили в стартапы, специализирующиеся на дипфейк-технологиях, приблизительно $187,7 млн

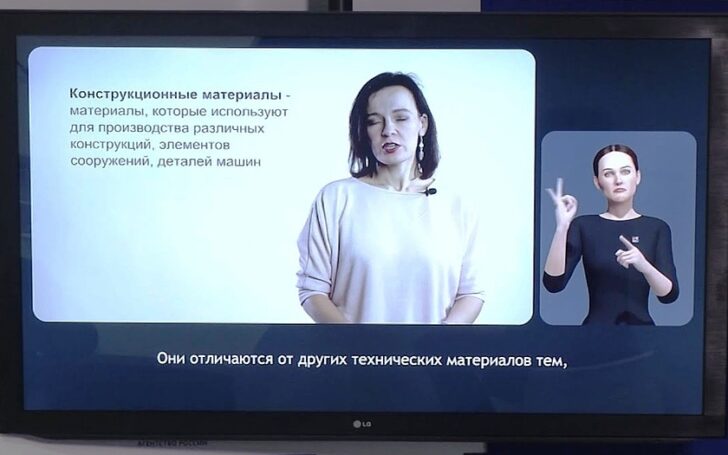

В начале 2022 года технологию сурлоперевода собираются внедрить в учебный процесс НГТУ, а позже вывести для широкого и, что важно, бесплатного использования

Сегодня все больше людей понимают, что за нейросетями будущее, и что на них можно делать вещи, которые раньше были невозможны

Эксперты по искусственному интеллекту предупреждают людей, чтобы они были внимательны к возможности подобных мошеннических атак

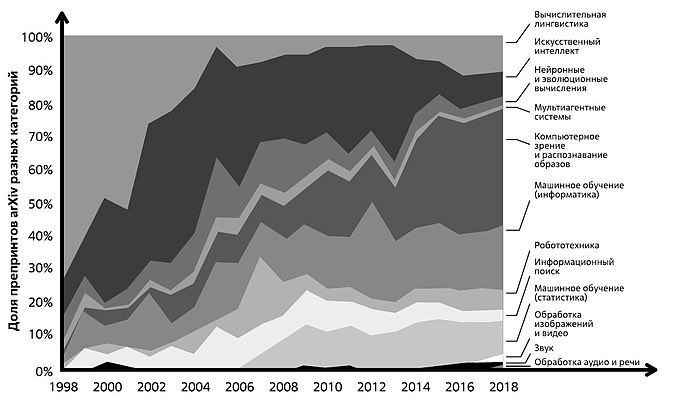

Отрывок изданной в 2023 году книги Михаила Лысачева и Александра Прохорова «Искусственный интеллект. Анализ, тренды, мировой опыт»

Китайская Tencent Cloud обещает создавать цифровые копии людей высокой чёткости, используя всего три минуты живого видео и 100 произнесённых фраз

К 2025 году ожидается, что глобальный рынок ИИ достигнет $190 млрд, что в 5 раз превышает объём 2021 года, составляющий $38 млрд

В этой статье мы разберём новые удивительные способности языковой модели из семейства GPT (от понимания мемов до программирования)

После шести недель разговоров с чат-ботом мужчина покончил с собой. По словам его супруги, она убеждена, что «без «Элизы» он всё ещё был бы жив»

Большая мультимодальная модель ИИ, которая может обрабатывать как текстовые, так и графические данные и выдавать текстовые ответы

Китайская PR-компания Bluefocus Intelligent Communications решила заменить своих копирайтеров и графических дизайнеров генеративными моделями ИИ

Наряду с приостановкой новых бесплатных пробных версий Midjourney запретила использование определенных слов, таких как «арест»