Идею проекта представили на форуме регионального кинематографа «Новый вектор. Сибирь» в Белокурихе. Идею поддержала министр культуры Алтайского края

Рубрика: Генерация изображения

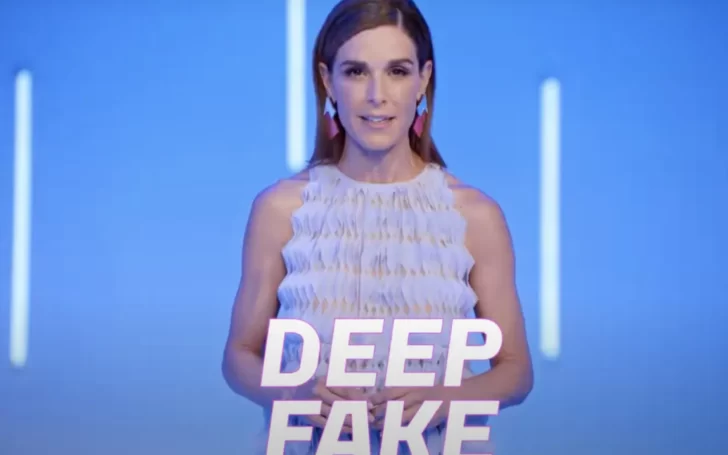

Член Палаты представителей США Александрия Окасио-Кортез рассказывает об ужасе, который она испытала, увидев себя в «порно-подделке»

В киберпространстве разгорается скандал, связанный с использованием генеративного ИИ для создания порнографических картинок без согласия изображённых на них лиц

Специфика технологии заключается в выборе ярлыка, который описывает то, что на самом деле изображено, чтобы размыть границы этого понятия

Образ Юрия Владимировича Никулина не будет использоваться в рекламных целях – ни на плакатах, ни в трейлерах фильма его не будет

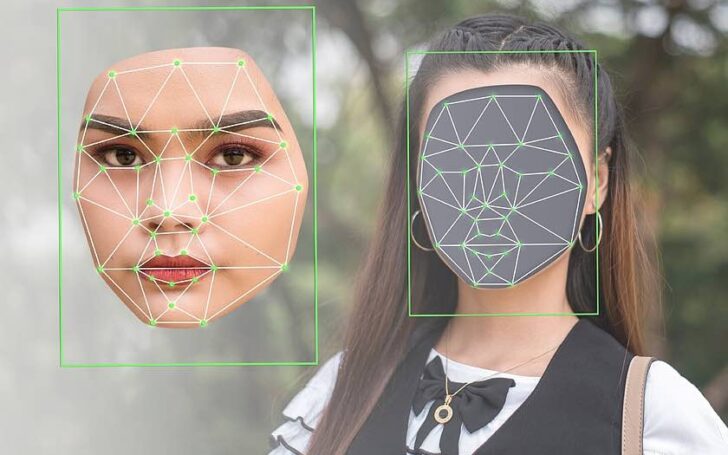

Мошенники воспользовались deepfake-технологией замены лиц и голосов. В ходе видеоконференции они выдали себя за руководство головного офиса

Согласно отчету биометрической компании iProov, мошенники все чаще используют инструменты искусственного интеллекта для создания поддельных изображений и видео

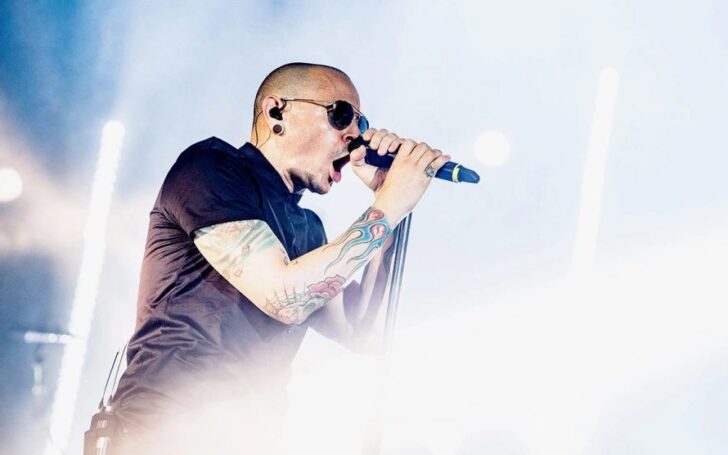

Рок-группа Linkin Park анонсировала выход трека Friendly Fire, записанного при участии покойного фронтмена коллектива Честера Беннингтона

Различных нейросетей, способных сгенерировать обнажённые изображения, существует немало, однако в центре международного скандала оказалось приложение ClothOff

Поддельное порно знаменитостей попало в заголовки газет несколько лет назад, но любой, кто изучает биометрию, знает о реальной угрозе гораздо больше

сли предложение кажется слишком хорошим, чтобы быть правдой, скорее всего, это мошенничество. Не позволяйте дипфейкам обмануть вас и лишить вас ваших сбережений

Исследователи говорят, что создание реалистичных выражений лица на основе аудиозаписей представляет собой сложную задачу.

Многие не узнают, что их фотографии могли использовать для создания дипфейков. Инициировать расследование или судебное разбирательство таких случаев сложно

Некоторые ИИ-модели работают настолько эффективно, что даже опытным специалистам сложно отличить сгенерированные изображения от реальных фотографий

В компании The Clueless создают продуманные легенды для своих виртуальных моделей, делая их большим, чем просто цифровой персонаж

Смена поп-культуры на мемы и отредактированные изображения может привести к сложностям с пониманием того, что реально, а что подделка

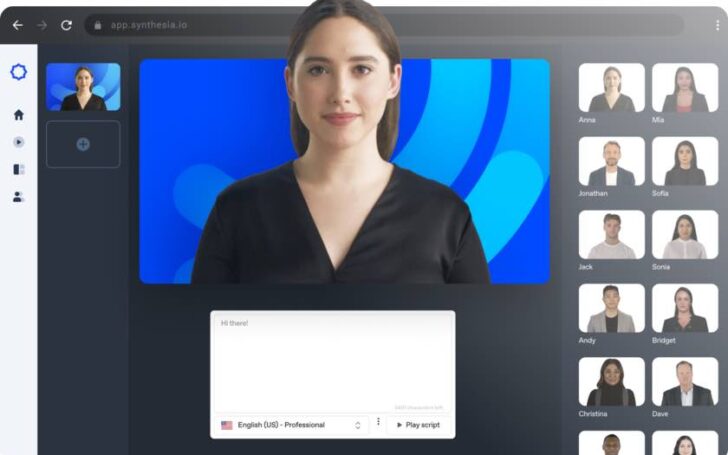

Пока учёные обсуждают может ли ИИ потеснить людей в Китае всё уже случилось: ИИ-модели стали популярными ведущими на каналах электронной коммерции

Как и другие технологии искусственного интеллекта, внедрение виртуальных ведущих новостей также вызвало опасения по поводу потери рабочих мест

Как отмечает Decider, о том, что часть роликов могла быть создана с помощью Deepfake, участникам проекта сказали только после их показа

Искусственный интеллект может манипулировать общественным мнением, финансовыми рынками и политическими процессами. Это новые вызовы и угрозы для общества

Эксперты по защите детей заявляют, что не могут противостоять тысячам «изображений сексуализированного насилия над детьми, созданных искусственным интеллектом»

Платформа Synthesia позволяет создавать виртуальные копии человека в том числе для проведения презентаций и онлайн-обучения

ФБР настоятельно рекомендует проявлять осторожность при размещении личных фотографий, видео и идентифицирующей информации в социальных сетях

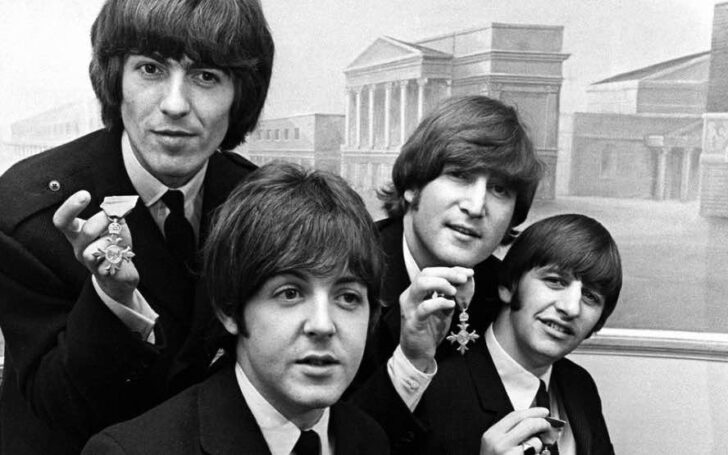

Пол Маккартни не раскрыл, о какой конкретно песне идёт речь, однако многие предполагают, что это «Now and Then» 1978 года

Вы познакомитесь с новейшим алгоритмом без какой-либо цензуры и научитесь применять его вне зависимости от используемого оборудования или установленной ОС