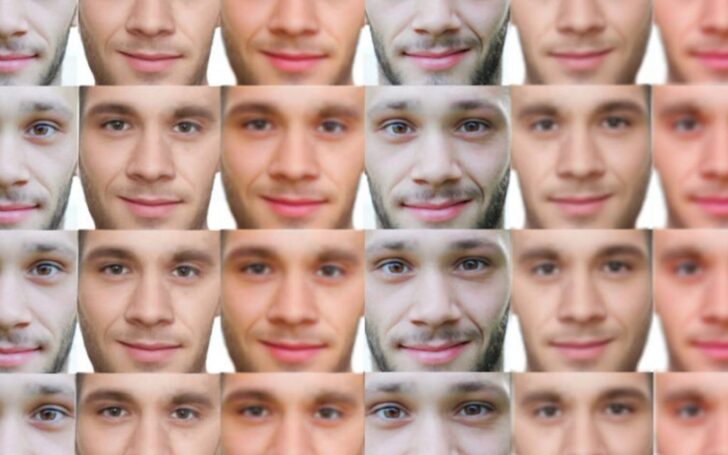

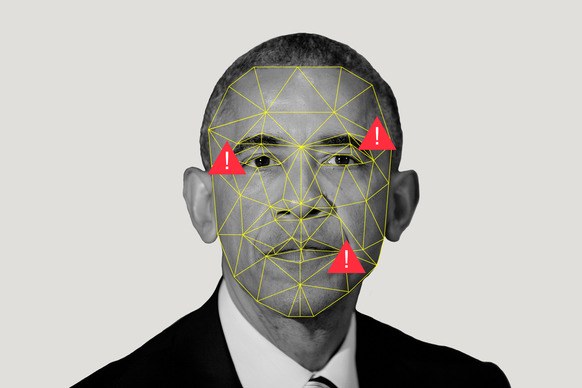

Благодаря развитию искусственного интеллекта понять, где реальность, а где подделка, становится все сложнее. Если в прошлом году опасения вызывала технология deepfake, то сейчас появляется феномен fake face, то есть создание неотличимых от настоящих изображений несуществующих людей. По мнению экспертов, эта технология активно используется для политической пропаганды

Рубрика: 2D Лицо

Разработчики уверяют, что точность инструмента может достигать 99,9%, однако детектор не во всех случаях «уверен» почти на 100% в своем решении. Также в будущем планируется обучить систему различить, изменялись ли другие объекты на видео или фото

«Не разговаривайте с незнакомцами», — посоветовали нам родители. В эпоху двойной жизни: реальной и виртуальной:« Не раскрывайте все в Facebook»!

В основу представленного VIEN сервиса легла технология Fake Video Detection Service (FVDS), работающая, в свою очередь, с помощью моделей компьютерного зрения, позволяющего покадрово оценить и классифицировать все присутствующие на видеозаписях объекты

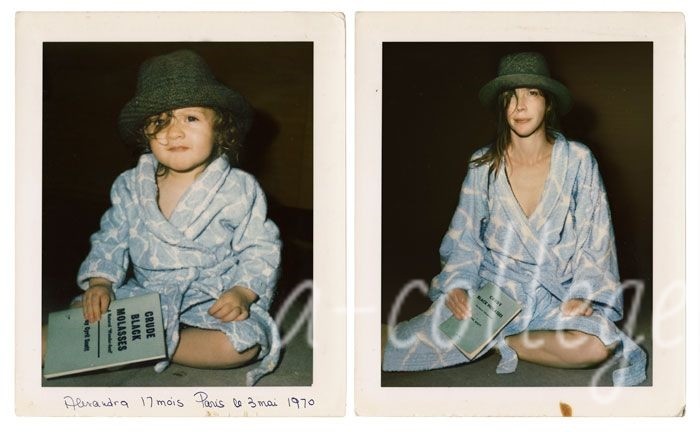

«Вечерний Ургант», Надежде Михалковой и Максиму Маринину предложил определить, изображения каких известных людей были объединены в фотографии

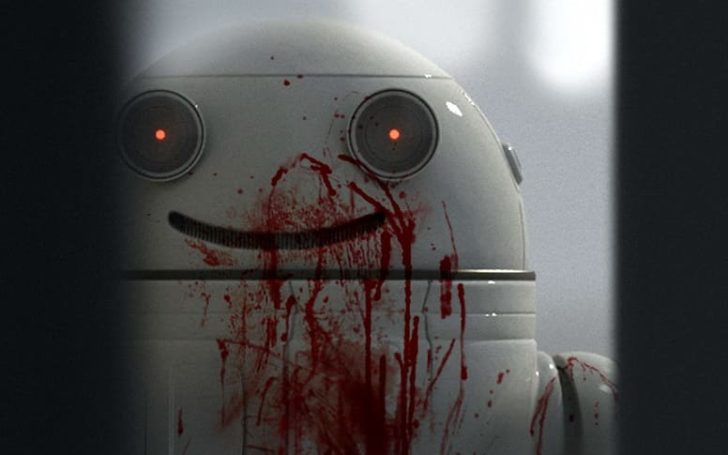

Авторы дипфейков могут шантажировать руководителей крупных компаний, угрожая опубликовать фейковое видео, способное подорвать их репутацию, если те не заплатят отступные. Также мошенники могут, например, проникнуть в вашу сеть, сымитировав звонок от IT-директора и обманом заставив сотрудников предоставить пароли и привилегии доступа, после чего ваши конфиденциальные данные окажутся в полном распоряжении хакеров

Нейросети стали революцией, это факт. Есть нейросеть которая определяет пьяных по фото лба, например. И это .. лишь начало

Для чего нужны фейки? Ложную информацию используют, чтобы повысить медиатрафик, сформировать общественное мнение, дискредитировать конкурента или потроллить публичного человека. Фейки стали мощным инструментом влияния и обрели новую силу в цифровую эру. Характерно, что число ложных новостей значительно возрастает во время политических кампаний, военных конфликтов и кризисных ситуаций. Естественно отследить каждую фиктивную новость невозможно.

Для того чтобы минимизировать риски целевых фишинговых атак при помощи дипфейков в корпоративной среде, необходимо информировать пользователей о новых типах вредоносной активности и быть начеку в ситуациях, когда поведение собеседника в телефонном разговоре или голосовом сообщении кажется необычным.

Мутные воды лжи накрыли континент правды: всемирный потоп повторился в 2016 году, когда объём искажённых сведений впервые превысил интернет-достоверность.

Человечество склонно доверять всему новому. Так было сначала с газетами, потом с радио, а затем с телевидением, интернетом, социальными сетями, телеграм-каналами и ютуб-видео. Эти средства массовой коммуникации на протяжении веков перенимали эстафету доверия. Но объединяет их одно: они создают в сознании людей представление о событиях, в которых сами читатели, слушатели, зрители не принимали участия и не были свидетелями.

AI все чаще присутствует в нашей повседневной жизни. Технологические компании используют огромное количество данных, доступных им, чтобы сделать более точные прогнозы, отследить наши запросы и предложить новые услуги. Поскольку AI уже используется во всем мире, возникает вопрос, кто несет ответственность за решения, принимаемые им?

Группа исследователей из лаборатории Университета Саймона Фрейзера в Канаде разработала творческий ИИ, который рисует портреты людей, передавая черты личности и эмоции. Прежде чем как рисовать, ИИ «разговаривает» с вами. Информация об исследовании опубликована в журнале arXiv.

У людей в мозгу есть функция стереотипов. Это полезная функция, поскольку не может каждый обыватель знать про две сотни вирусов

После подведения итогов конкурса команда исследователей из лаборатории Facebook AI и Калифорнийского университета в Сан-Диего подвергла три алгоритма

RT выпустил шуточный ролик, в котором представил, о чём разговаривают со своими психологами ведущие политики мира в преддверии 15-летия телеканала

В проекте постановления указано, что решение об использовании ЕБС будут принимать вузы в добровольном порядке. Если такое решение будет принято, то студентам придется сходить в отделение банка, оснащенное системой сбора биометрии, сфотографироваться и оставить образец голоса.

Эксперты компании «Инфосистемы Джет» предупредили о новом способе обмана в интернете, когда мошенники выманивают деньги у жертв

Znak.com поговорил с Марией Чмир основательницей и генеральным директором стартапа Dowell — компании, развивающей технологию Deepfake.

Реклама с виртуальными моделями, цифровые телеведущие и фейковые речи президентов – реальность, которую формируют алгоритмы машинного обучения. В 2020 году технологии искусственного интеллекта глубже проникают в сферы телекоммуникаций, развлечений и формируют новые рынки. За развитием дипфейков внимательно наблюдают специалисты по кибербезопасности, расследуя новые формы мошенничества с использованием передовых технологий

Обычно для качественного синтеза речи с помощью технологии TTS нужно не меньше 20 часов речи в записи, но у команды было только четыре минуты

«Гарантия того, что снимается селфи от живого человека, а не с фотографии другого снимка, маски или видео, является одновременно технически сложной и критически важной. Сделать это пассивно, без каких-либо действий со стороны пользователя – это вишенка на торте»

Хочется напомнить о существовании Photoshop. В своё время он сильно изменил мир. Тем не менее человечество адаптировалось, также будет и с Deepfake

Для будущих публикаций проблема теоретически будет решена, но остается проблема архивов: защищая только вновь создаваемый контент – это не окажет практически никакого влияния на уже размещённые материалы

Знаете ли вы, что она позволяет любому человеку сделать лицо знаменитости? Эксперты считают, что deepfake может быть опасным оружием в информационных войнах