Если вы занимаетесь программированием, то скорее всего когда вы слышите Swift, вы думаете о разработке приложений на IOS и MacOS

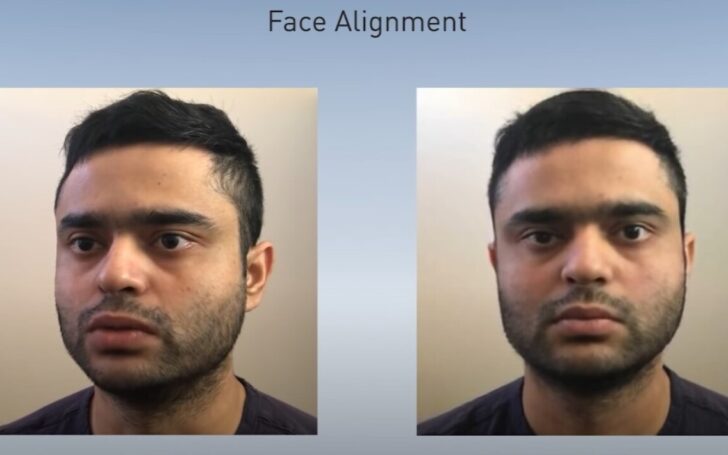

Израильский стартап CannyAI использует технологию VDR (Video Dialogue Replacement) для перевода видео на разные языки, устраняя необходимость в субтитрах. Сооснователь компании Джонатан Хейманн рассказал порталу NoCamels о создании проекта и особенностях его работы

Кровоток был исследован как метод обнаружения атак биометрической подделки и, как сообщалось, даже был реализован в датчике отпечатков пальцев Samsung Galaxy

Знаете ли вы, что она позволяет любому человеку сделать лицо знаменитости? Эксперты считают, что deepfake может быть опасным оружием в информационных войнах

Приведем смысловую выжимку из острой и насыщенной дискуссии, состоявшейся на секции «Цифровая инфраструктура, технологии искусственного интеллекта и вопросы информационной безопасности в банковской сфере» в рамках ИНФОФОРУМ-2020 В дискуссии участвовали такие эксперты отрасли, как Валерий Комаров, начальник отдела обеспечения осведомленности Управления…

Восстановление цвета на изображении — это одна из задач в компьютерном зрении. Исследователи из National Tsing Hua University и Virginia Tech обучили модель

Главное преимущество биометрии, по мнению 47% участников опроса, — это то, что она избавляет их от необходимости запоминать многочисленные пароли и ПИН-коды

Это не первый случай, когда фильтры приложения Gradient становятся виральными. В начале года с его помощью люди узнавали, кто они по национальности

Недавно компания из Амстердама Deeptrace Labs опубликовала отчет «The State of Deepfakes: Landscape, Threats, and Impact», в котором исследует дипфейки, распространенные на сайтах, форумах и в мобильных приложениях. Хотя многие беспокоятся, что дипфейки будут использоваться для манипулирования выборами и создания хаоса…

Подобно данным биометрического распознавания лица и походки, эта информация, называемая актиграфией (actigraphy), может использоваться для идентификации людей. Ученые говорят, что они имитировали актиграфические профили людей в 94,5% случаев

Нейросеть меняет изображение по желанию заказчика, и, скажем, обычный продавец на видео выглядит, как президента США Дональда Трампа

Команда DeepMind приобрела известность как разработчик алгоритма AlphaStar, гроссмейстера шахмат, го, сеги, а также 57 классических игр Atari и стратегической многопользовательской игры StarCraft II.

Речь идет о компании OpenAI, которую несколько лет назад основал Илон Маск. Сейчас миллиардер уже не причастен к проекту, но прогресс продолжается большими шагами и мы можем взглянуть на несколько примеров

Распространение фейковых новостей в современном медиа-пространстве ставит перед обществом новые злободневные вопросы по поводу того, как эффективнее противостоять им. Взывать к совести и морали мало что даст, уверены одни, нужно действовать решительными мерами и штрафовать «инфоразносчиков». Другие считают, что фейки остановят не штрафы, а популяризация нравственных ценностей, серьезный разговор об ответственности человека за свои поступки и действия.

Дипфейк – технология синтеза изображения, основанная на искусственном интеллекте и используемая для замены элементов изображения на желаемые образы

Создать дипфейк на обывательском уровне можно буквально за полторы минуты. Однако для того, чтобы ролик получился хорош, над ним нужно поработать специалистам

Новое поколение уже променяло свободу на возможность играть в компьютерные игры. Цифровые аватары нашим детям зачастую дороже собственных физических тел

О RefaceAI

Компания RefaceAI разрабатывает технологии искусственного интеллекта в области замены лиц (face swap) на фотографиях, гифках и видео. Они известны своими приложениями Doublicat и Reflect, первое из которых было скачано более 900 000 раз за несколько месяцев, с момента его выхода. В начале этого года, Doublicat вошел в список лучших стартапов по версии Product Hunt.

В тестировании PAD обнаружение живости 2D зарегистрировало более 97% эффективности в отношении артефактов подделки уровня 1-3, как определено в документации по артефактам тестирования PAD iBeta/NIST

Оценивая угрозы на основе потенциального вреда, прибыльности, жизнеспособности и поражения, группа определила, что deepfake, технология, которая уже существует и распространяется, представляет наивысший уровень угрозы

Решение ID R&D с одним изображением пассивной биометрической живучести прошло тестирование уровня 2 компанией iBeta Quality Assurance на соответствие стандарту ISO/IEC 30107-3 Presentation Attack Detection (PAD) с нулевым допуском подделок

Риск COVID-19 в США, где на данный момент коронавирусной инфекций заражены более 2,6 млн человек, удерживает людей от посещения избирательных участков, как это сделал испанский грипп на выборах столетие назад

Комплект разработки на основе искусственного интеллекта от NVIDIA получил название SDK Maxine. С его помощью можно создавать реалистичные аватары для видеоконференций. Искусственный интеллект, лежащий в основе системы, создаёт аватар по статичному изображению лица и потом «оживляет» его, опираясь на данные о положении ключевых точек на лице пользователя во время разговора

Компания Acuant, ведущий мировой провайдер проверки личности, объявила, что Acuant FaceID обеспечивает распознавание лиц с технологией определения живости

По подсчётам специалистов, каждый месяц на порносайты загружается до 1000 deepfake видео. Таким образом на ресурсах появляются ролики «с участием» известных актрис и певиц