Где проходит грань между дипфейком и технологией face swap? Какие технологические этапы предстоит пройти, чтобы вернуть на экраны Жоржа Милославского? В чем слабые стороны у нейросетей? Какие видеокарты нужны для их обучения?

Метка: Deepfake

Deepfake – обман систем биометрической идентификации

При анализе цифрового фотоснимка изображение разбивается для анализа на маленькие квадраты, а видео разделяется на кадры, и в каждом кадре анализируются локальные области на предмет наличия искажений

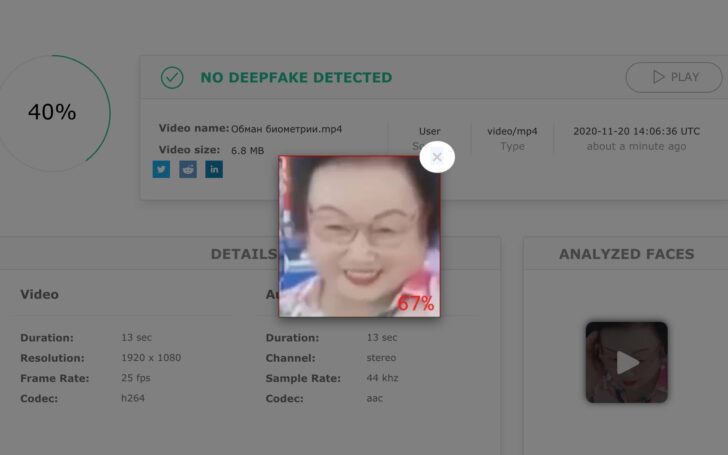

Проверить видео на наличие признаков дипфейка поможет сервис deepware.ai. Он анализирует все лица на видео и в результате выдаёт вероятность подделки в процентном соотношении

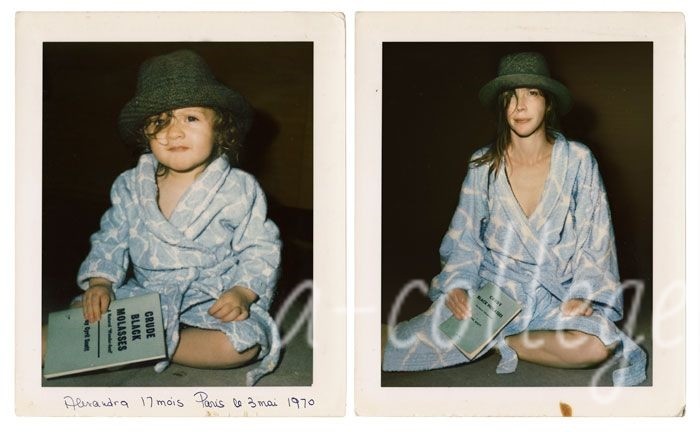

Существуют простые способы отличить deepfake изображение от подлинного, например, внимательно рассмотрев задний фон изображения, детали, углы — так называемые «швы» картинки. Однако если синтез произведен качественно и с пост-обработкой, заметить его невооруженным глазом становится все сложнее

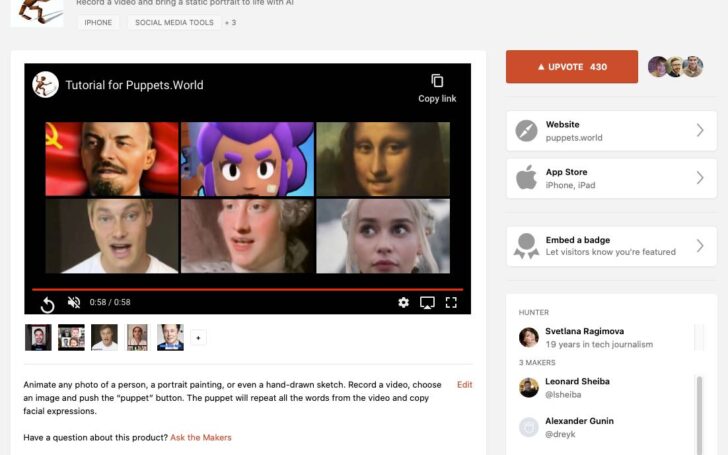

Японский стартап EmbodyMe Inc. разработал приложение, которое считывает движения лица и жесты пользователя в реальном времени и накладывает их на изображение

Отличить реальную запись от подделки становится всё сложнее и сложнее. Сейчас, чтобы это сделать – приходится приложить не мало усилий. Рассмотрим это на текущем примере:

Не исключено, что в будущем эта разработка будет использована в онлайн-сервисах различных исторических организаций, в музеях или политическими партиями для оживления известных фигур. С одной стороны это повысит интерес к истории, но создание исторически не подтверждённых подделок пугает возможностью «документального» подтверждения для изменения исторической правды

Согласно заявлению компании, решение Marquis использовалось для аутентификации более 10 000 идентификационных данных преступников

Крамер использовал несколько сотен фотографий людей в гриме и масках зомби, чтобы нейросеть могла создавать реалистичные изображения живых мертвецов

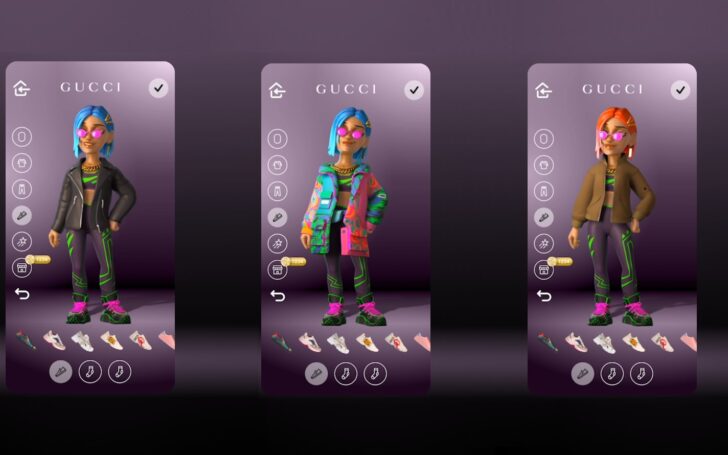

Идея заключается в том, что поклонники марки смогут «примерить» одежду или аксессуары при помощи аватаров, AR и VR технологий, а потом купят товар по-настоящему. Кроме того, маркетологи получат возможность изучить предпочтения пользователей и выяснить, какая продукция наиболее привлекательна для молодой аудитории

Системы, предназначенные для обнаружения дипфейков — видео, которые манипулируют реальными кадрами с помощью искусственного интеллекта — могут быть обмануты

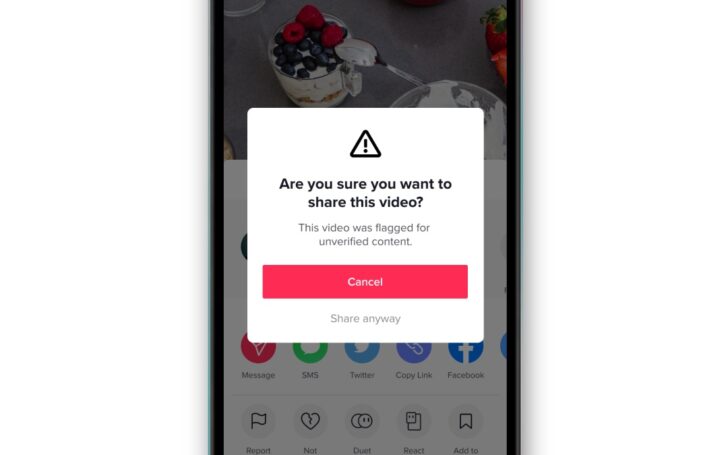

Если эксперты не уверены в точности или не могут подтвердить достоверность данных, TikTok будет помечать подобные видео как содержащие «непроверенный контент»

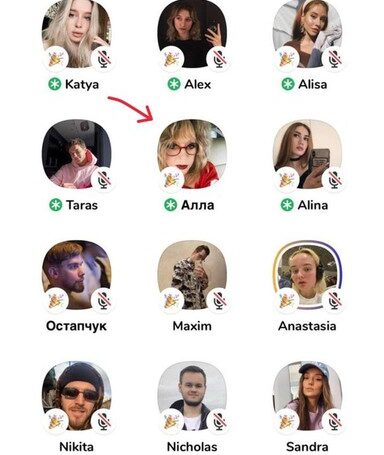

Способом борьбы с фейками для Clubhouse могла бы стать метка подтвержденного аккаунта и включение на уровне приложения идентификации, защищающей от подделки голоса с помощью технологий голосовой биометрии. Для получения такой метки соцсеть может обязать пользователя оставить «слепок голоса», а на уровне самого приложения создать голосовую биометрию, которая будет определять, что говорящий соответствует цифровому слепку и голос не является воспроизведением с ноутбука или диктофона

В официальном документе, опубликованном фирмой Nisos, специализирующейся в области кибербезопасности, описываются пять инцидентов, связанных с deepfake аудио-атаками

В затруднение распознавания людей в масках есть и положительная сторона. Проблему, с которой сталкиваются сервисы аутентификации, предстоит решить программам распознавания лиц

Конечно, мы разослали ссылку на Product Hunt всем знакомым. Я попросила ребят в социальной сети Mesto и в Телеграм-чате Silicon Pravda поддержать нас. Но большая часть голосов пришла от незнакомых людей, что весьма порадовало

Редактирование отдельных элементов на видеозаписи требует покадровых изменений. Обычно это делается вручную, как в мультипликации, или с использованием специальных инструментов, которые имеют ограниченный функционал и могут выполнять только отдельные запрограммированные действия. Команда разработчиков Google и Оксфордского университета смогли разделить каждый кадр видео на отдельные слои и научила ИИ распознавать в них людей или другие движущиеся объекты

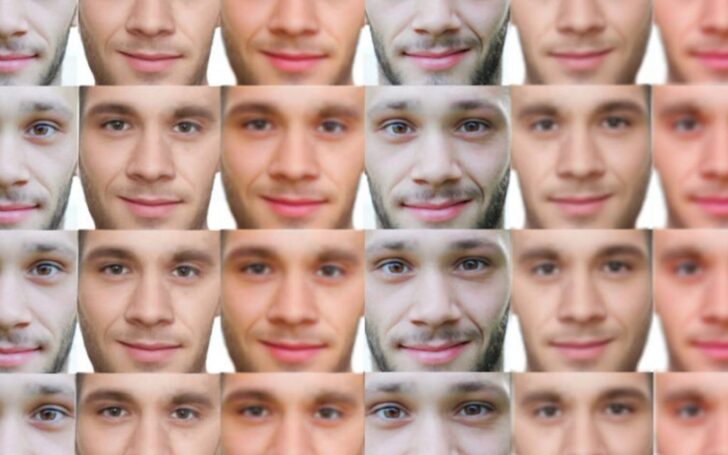

Благодаря развитию искусственного интеллекта понять, где реальность, а где подделка, становится все сложнее. Если в прошлом году опасения вызывала технология deepfake, то сейчас появляется феномен fake face, то есть создание неотличимых от настоящих изображений несуществующих людей. По мнению экспертов, эта технология активно используется для политической пропаганды

По условиям тендера, победителю предстоит выполнить работу на тему «Исследование возможных способов выявления признаков внутрикадрового монтажа видеоизображений, выполненного с помощью нейронных сетей». Кроме того, исполнитель должен будет составить техзадание на разработку аппаратно-программного комплекса для анализа видеофальшивок.

Разработчики уверяют, что точность инструмента может достигать 99,9%, однако детектор не во всех случаях «уверен» почти на 100% в своем решении. Также в будущем планируется обучить систему различить, изменялись ли другие объекты на видео или фото

«Не разговаривайте с незнакомцами», — посоветовали нам родители. В эпоху двойной жизни: реальной и виртуальной:« Не раскрывайте все в Facebook»!

В основу представленного VIEN сервиса легла технология Fake Video Detection Service (FVDS), работающая, в свою очередь, с помощью моделей компьютерного зрения, позволяющего покадрово оценить и классифицировать все присутствующие на видеозаписях объекты

Сейчас мы входим в мир нулевого доверия. Никому и ничему в этом мире нельзя доверять, не увидев подтверждение в виде криптографической цифровой подписи

«Вечерний Ургант», Надежде Михалковой и Максиму Маринину предложил определить, изображения каких известных людей были объединены в фотографии

Авторы дипфейков могут шантажировать руководителей крупных компаний, угрожая опубликовать фейковое видео, способное подорвать их репутацию, если те не заплатят отступные. Также мошенники могут, например, проникнуть в вашу сеть, сымитировав звонок от IT-директора и обманом заставив сотрудников предоставить пароли и привилегии доступа, после чего ваши конфиденциальные данные окажутся в полном распоряжении хакеров