Копировать кого-то или что-то – это не придумывать новое. Посмотрите видео, в нём говорится, катким будет следующий шаг, после deepfake

Рубрика: Мнение

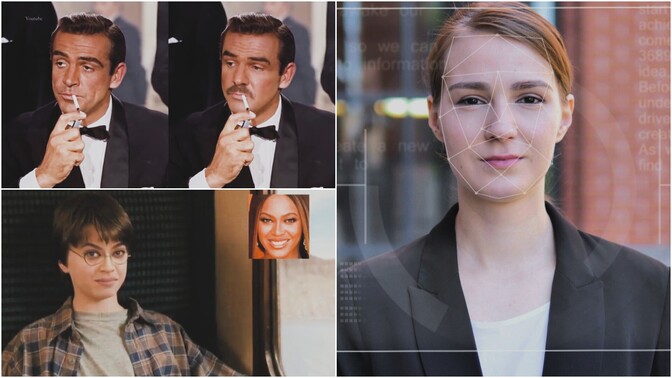

Дипфейки можно применять и во благо. Например, во время программы защиты свидетелей или в производстве документальных фильмов

Парламентарий намерен поднять этот вопрос на площадке Экспертного совета по законотворческой деятельности «Единой России»

Минуту назад вы обсуждали новый отпуск в чате, и вот Instagram уже показывает вам рекламу отеля в нужной стране. Что это — прогресс или ожившая антиутопия?

Оказывается, дипфейки могут использовать не только киберпреступники, но и IT-стартапы. Синтетический контент пользуется в последнее время повышенным спросом

Сложная «работа» у телефонного мошенника. Нервная. Многие россияне уже наизусть знают их уловки и деньги жуликам с каждым годом достаются все тяжелее

Государство активно продвигает в банковском секторе Единую биометрическую систему (ЕБС), без устали рассказывая об удобстве и безопасности её использования

Deepfake с Илоном Маском, исполняющим песню «Трава у дома» моментально набрало миллионы просмотров на Youtube, а фейковый аккаунт Тома Круза взорвал TikTok

Уже есть искусственный интеллект, который может отслеживать привлекательность того или иного контента на основе вашего взаимодействия

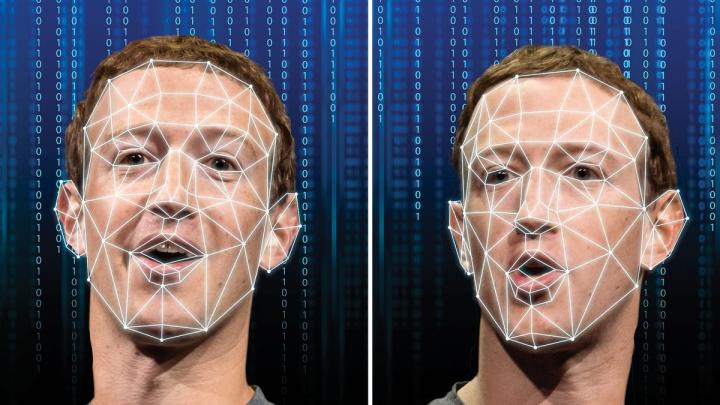

Распространение deepfake-видео в соц.сетях растёт лавинообразно. Недавно было несколько вирусных роликов-подделок за год, а сегодня они появляются ежедневно

Какая память в виртуальном пространстве останется от человека, когда его не станет? Современные технологии дают сразу несколько вариантов ответа на этот вопрос

Для чего нужен deepfake? Этот вопрос не стоит перед бизнесменами и перед мошенниками, которые готовы на этом зарабатывать

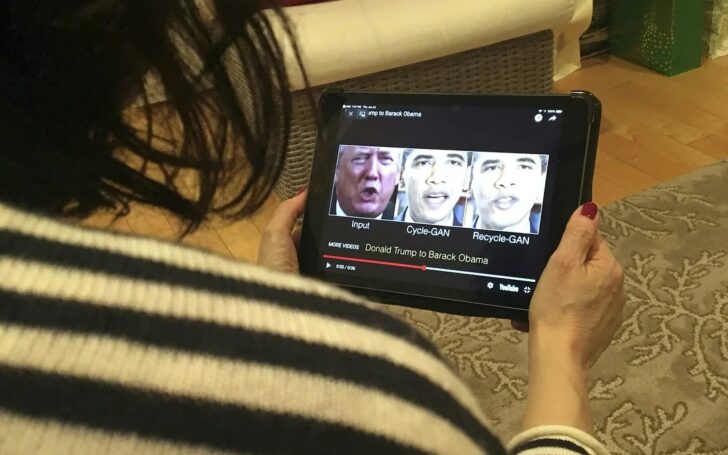

Развитие технологии deepfake дало широкий простор не только для мошеннической деятельности, но и для новых вариантов организовать легальный бизнес

CyberCube заявила, что помимо технологии подделки видео и аудио, она также исследует «растущее использование традиционных методов социальной инженерии

Federal Bureau of Investigation (FBI) предостерегают, что Deepfake будет одной из самых больших угроз в ближайшие годы. Это касается новостей и удалённой работы

Без всякого сомнения, на реальной сцене и эстраде главными действующими персонажами все еще останутся люди. А в интернете их могут заменить AI drag-артисты

Эксперты США заявляют о том, что в ближайшее время технология глубинных подделок может представлять серьёзную опасность для национальной безопасности

Запрещать и не пущать» в случае фейков и дипфейков – абсолютно проигрышная стратегия. Хотя в ряде развитых стран уже прорабатывается законодательная база

В 2020 году наша компания выпустила 20 проектов с генерацией лица на видео: делали дипфейк для рекламных и образовательных сегментов, работали над кинофильмом и бесконечно создавали цифровые копии знаменитостей

Технология для создания дипфейков имеет открытый исходный код и доступен в Интернете. Хотя мы видим это в современных фильмах, мы не видели их в маркетинге

Главный эксперт по кибербезопасности «Лаборатории Касперского» Сергей Голованов рассказал о мошеннической схеме с использованием технологии дипфейков

Искусственный интеллект: угроза или шанс на будущее? Очевидно, что он уже сейчас серьезно влияет на структуру экономики и во все большей степени вторгается в частную жизнь людей. Александер Илич (Alexander Ilic), глава нового Центра изучения искусственного интеллекта при Швейцарской Высшей технической школе Цюриха (ETH Zürich), выступает за то, чтобы искусственный интеллект помогал человеку, а не заменял его

Актуализация проблемы на современном этапе, лингвистически обозначенная маркерами «фальшивых новостей» (Fake News) и «эпохи постправды» (Post-truth era)

Нередко мошенники могут представляться организациями, занимающимися благотворительностью или проводящими социальные опросы. Таким образом они могут получить у вас все необходимые данные под видом невинных вопросов

Депутат Рийгикогу Марко Михкельсон после встречи с лже-Волковым уверенно заявил, что подмена была сделана с помощью замены изображения